在AI时代,信息如洪水般涌来:每天阅读的论文、文章、代码仓库、数据集和图像堆积成山。传统笔记工具如Notion或Obsidian虽能记录,但维护成本极高——手动创建链接、摘要、思维导图,容易陷入"知识孤岛"。而LLM(Large Language Model,大语言模型)的出现,彻底改变了游戏规则。它不再只是聊天工具,而是知识操作的核心引擎,能自动将原始数据转化为结构化、可查询、自进化的个人知识库。

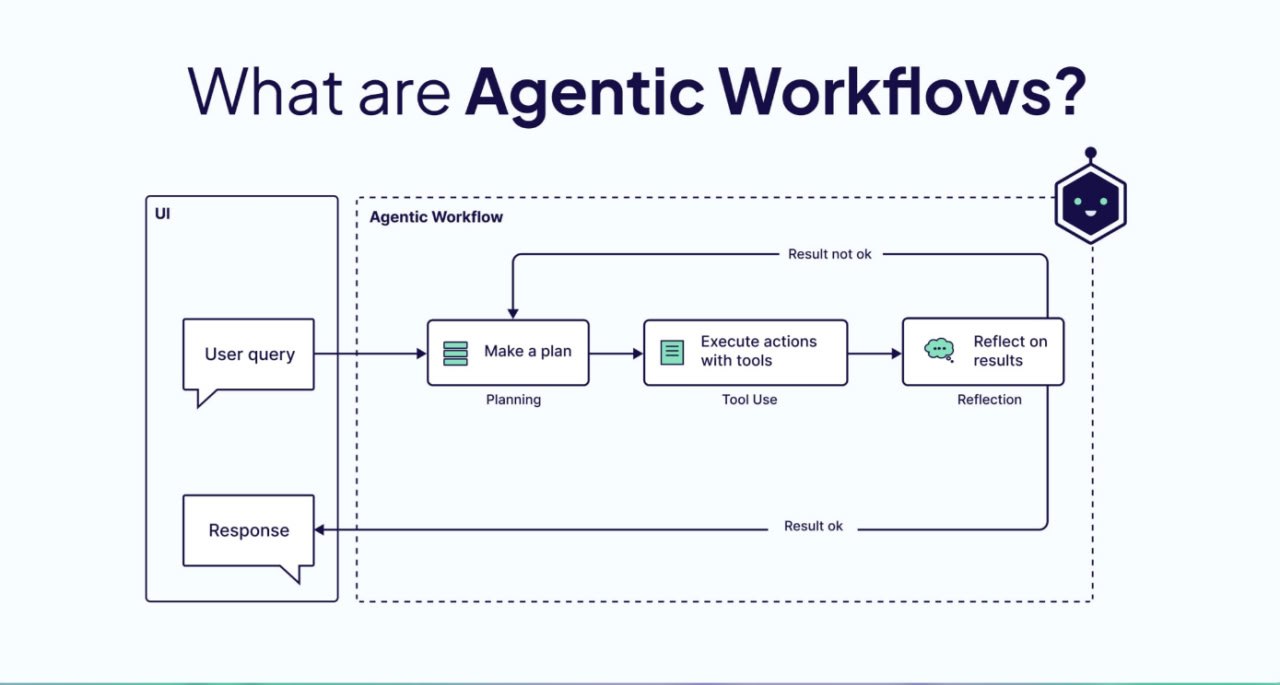

本文将从纯技术角度,详细拆解一套LLM驱动的Agentic(代理式)个人知识库构建方案。这套系统以Git仓库为核心,采用"Raw数据层 → 编译Wiki层 → Agent操作层 → 可视化前端"的分层架构,实现全自动化编译、复杂Q&A、输出生成和自我优化。无论你是AI研究员、软件工程师还是深度学习爱好者,都能一步步复现,打造属于自己的"AI第二大脑"。整个流程无需复杂向量数据库,仅靠LLM的原生上下文理解即可高效运转,彻底告别信息过载。

为什么需要LLM驱动的个人知识库?

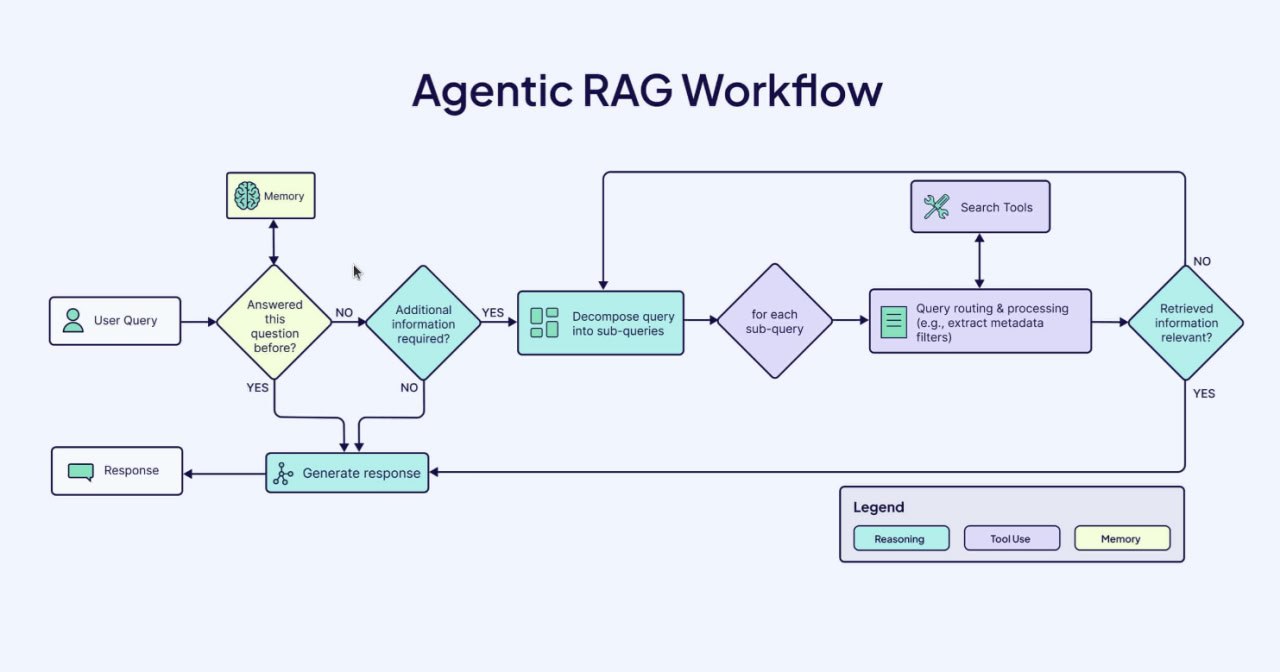

传统知识管理依赖人工整理:复制粘贴、打标签、画关系图。但在Context Window已扩展至200K+ tokens的今天,LLM能一次性"阅读"整个小型知识库,直接进行概念关联、矛盾检测和增量更新。这比RAG(Retrieval-Augmented Generation)更进一步——RAG依赖外部检索,而LLM在这里成为"知识编译器",主动维护索引和反向链接。

核心优势有三:

- 自动化规模化:一个知识库轻松容纳100+篇文章、40万+字,无需手动编辑。

- 智能增强:LLM不仅存储,还能生成新洞见、修复缺失、输出幻灯片或代码。

- 自我进化:通过linting机制,知识库持续自检一致性,形成"飞轮效应"——输入越多,输出越智能。

从工程视角,这套系统标志着LLM从"代码生成"向"知识操纵"的范式转变。你的token消耗将主要用于知识处理,而非简单问答。接下来,我们一步步拆解实现细节。

整体架构设计:分层与Git驱动

知识库采用纯文本+Git管理的仓库结构,便于版本控制和协作。推荐目录布局如下:

1 | personal-knowledge-base/ |

增量编译机制是灵魂:新数据放入raw/后,LLM仅读取变更部分 + 现有wiki上下文,进行针对性更新,避免全量重算。整个流程通过Git Hook或Cron Job自动化触发。Git确保每一次编译都可回滚,数据永不丢失。

这种架构的最大亮点在于"纯文本优先":所有wiki文件均为标准Markdown,LLM可直接解析,无需额外数据库。相比Notion的封闭生态,这套方案完全开源、可移植。

数据摄入层:从零到Raw的高效管道

摄入是第一步,目标是将碎片化信息标准化。推荐组合工具:

- 浏览器插件:用类似Obsidian Web Clipper的扩展,一键保存网页为Markdown,同时下载图像至raw/images/。这解决HTML转纯文本的痛点。

- 自动化脚本:Python + Playwright批量抓取arXiv论文、GitHub Repo。示例代码如下:

1 | import os |

- PDF与图像处理:用PyMuPDF将PDF转文本,再喂给Vision LLM(如GPT-4o或Claude-3.5)生成描述,嵌入

。 - 早期策略:初期人工审核每个raw文件;后期直接用提示"自动归档此文档到知识库"实现零干预。

摄入完成后,raw/成为"事实来源",所有后续操作均以此为锚点,确保知识可追溯、防幻觉。

LLM编译Pipeline:Raw到Wiki的核心魔法

编译是Agentic系统的核心。LLM扮演"编译器",接收raw新文件 + 整个wiki上下文,输出更新后的Markdown文件。

系统Prompt设计模板(适用于任何前沿LLM):

1 | 你是个人知识库编译Agent。目标:将新raw文档无缝融入现有wiki。 |

编译流程伪代码:

1 | def compile_to_wiki(raw_path: str): |

关键技巧:使用低temperature保证输出稳定;分步Prompt(先摘要、再概念、再链接)避免一次性过载;增量模式下仅更新受影响的文件。

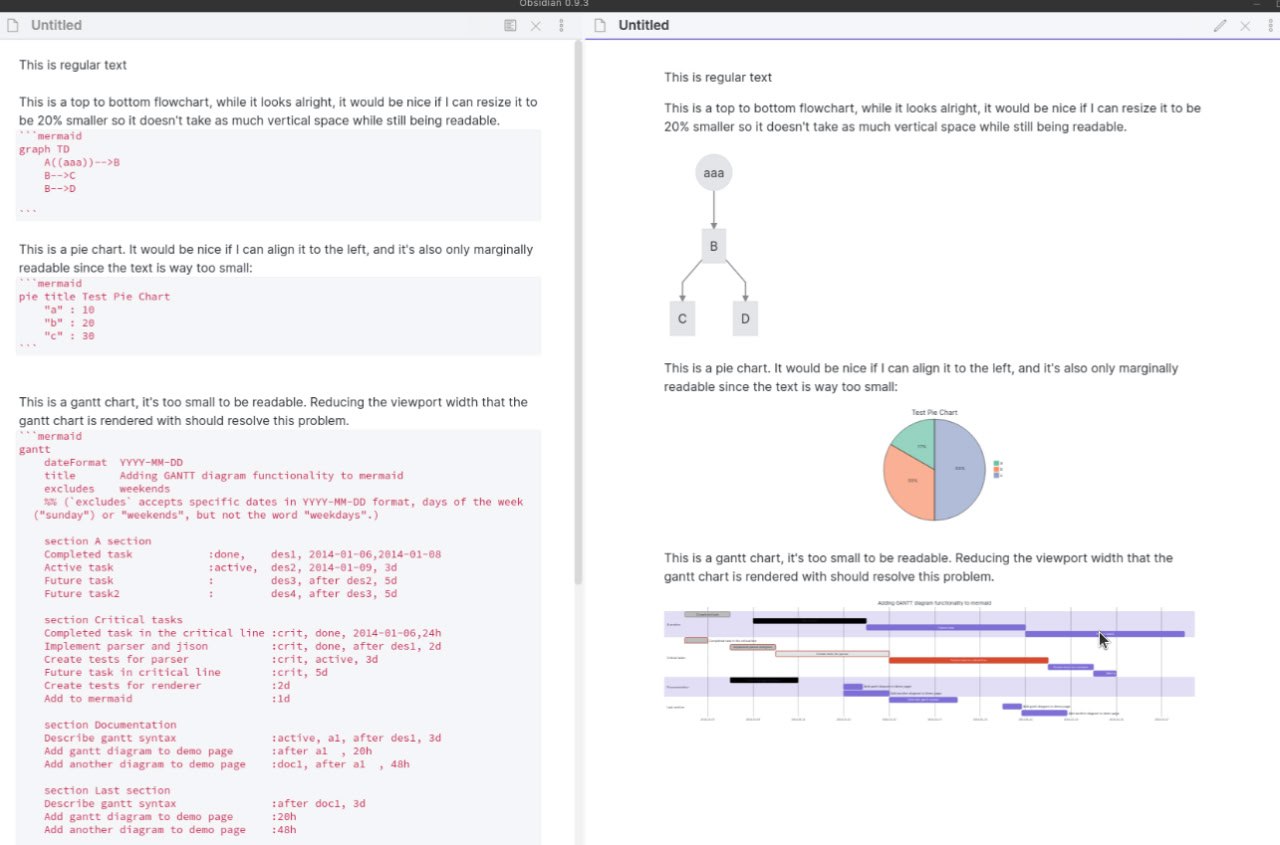

编译后,wiki/自动形成知识图谱:概念文章相互链接,摘要提供快速概览,Mermaid图直观展示依赖关系。

Obsidian前端集成:人类友好的可视化层

Obsidian是最佳前端——它原生支持Markdown、反向链接、Graph View和插件生态。配置方式:

- 将wiki/软链接到Obsidian Vault。

- 安装插件:Advanced URI(外部调用)、Dataview(动态查询)、Mermaid(图表渲染)。

- 自定义CSS让Graph View高亮新编译节点。

在Obsidian中,你能实时浏览"第二大脑":点击概念节点即跳转,Graph View展示整个知识网络。LLM编译后的backlinks让搜索像"脑内闪回"般高效。

Agentic Q&A与输出生成:知识的动态利用

查询不再是简单搜索,而是Agent驱动的复杂任务。query_agent.py封装提示:

1 | 你是知识库查询Agent。用户问题:[query] |

示例交互:

- 查询"Transformer在2026年的最新优化" → LLM检索concepts/,生成带公式和Mermaid架构图的报告。

- 输出图像:用Vision LLM描述需求,调用Flux或DALL·E生成并存档。

这层让知识库从"存"变成"用",支持研究、写作、演讲全场景。

Linting与自我优化:知识库的"免疫系统"

知识库会随时间产生漂移(矛盾、过时、缺失)。lint_agent.py定期运行:

1 | def run_lint(): |

Linting可每周Cron触发,发现新论文后自动更新关联概念。长期运行下,知识库准确率持续提升,形成闭环。

挑战、优化与未来扩展

挑战:

- Token成本:初期编译耗费较多,后期增量优化可降至10%以下。

- 幻觉风险:始终以raw/为金标准,LLM输出需带来源引用。

- 规模扩展:超1000文件时,可引入轻量向量索引作为辅助(但非必需)。

优化技巧:用本地LLM(如Llama-3.1-70B)降低成本;并行编译多份raw;集成测试框架验证输出格式。

未来扩展:

- 合成数据生成:LLM基于wiki生成新论文草稿,用于模型微调。

- 多模态:集成视频、音频转录,扩展为全媒体知识库。

- 产品化:将此workflow打包成开源CLI工具,甚至SaaS平台,让普通用户零代码打造第二大脑。

社区已有类似项目在GitHub涌现,许多开发者正复制此架构,探索"知识飞轮"在教育、科研、企业中的应用。

结语:开启你的知识管理新纪元

构建LLM驱动的个人知识库,不是简单堆砌笔记,而是打造一个活的、会思考的AI第二大脑。它将你的碎片思考转化为系统智慧,让创造力指数级增长。从今天开始,搭建raw/目录,运行第一个compile_agent,你会发现:知识不再是负担,而是源源不断的燃料。

立即行动吧!克隆一个Git仓库,放入第一篇raw文章,让LLM为你编译第一个概念页面。未来属于那些让AI替自己思考的人——而你的个人知识库,正是起点。