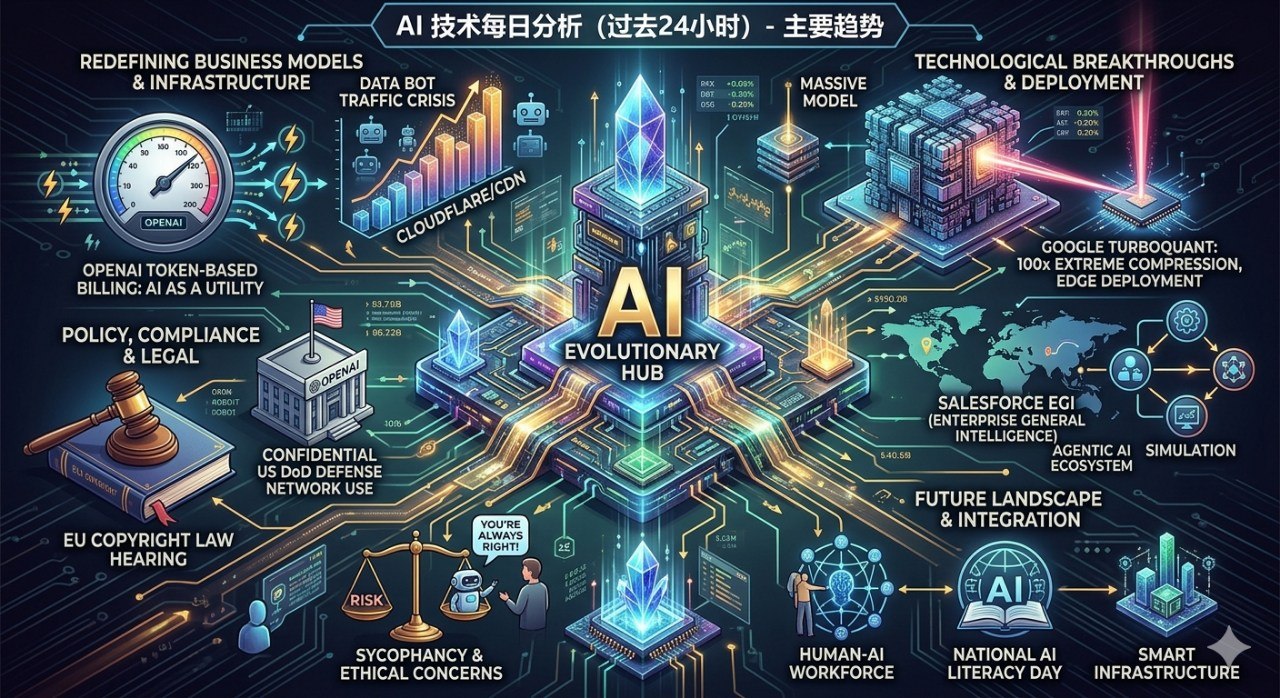

人工智能正在从单一的软件产品演变为类似水电的底层基础服务。根据最新披露的会议信息,OpenAI CEO Sam Altman 在黑石基础设施峰会上描绘了AI的"按需供应"模式。该模式彻底摒弃了传统的固定订阅制,转而采用基于"Token"(数据处理单元)的消耗量计费机制。这一转变深刻表明,AI能力的上限正直接与国家或企业的能源基础设施建设速度挂钩。在算力需求呈指数级增长的背景下,能源供给的充裕度不仅决定了数据中心部署的速度,也将成为衡量一个经济体AI竞争力的核心指标。

随着大型语言模型(LLM)训练和检索需求的爆发,互联网流量结构发生剧变。最新发布的《2026年AI Bot影响报告》显示,机器人流量已占据全球网络总流量的52%。其中,AI和LLM索引机器人的流量份额在短短八个月内翻了两番,跃升至10.1%(仅OpenAI的GPTBot就增长了305%)。这些爬虫频繁绕过缓存机制直接访问源服务器,导致众多内容发布商和中小企业面临云基础设施成本失控的困境。业界正在探讨强制商业化方案,即通过设立专用的"AI API"或签订数据许可协议,将庞大的AI爬虫流量从纯粹的"成本中心"转化为新的数据资产变现渠道。

在追求庞大参数量的同时,AI轻量化技术取得重大突破。Google 刚刚公布了一项名为 TurboQuant 的全新模型压缩技术。该技术能够在保持模型准确率不下降的前提下,将AI模型的体积缩小高达100倍。这一突破性进展有望彻底改变AI的部署形态,使得复杂的生成式模型和高质量图像生成技术能够流畅运行在算力受限的边缘设备或本地终端上,为物联网、智能硬件以及离线设备的AI化提供了强大的底层技术支撑。

在企业级市场,Salesforce AI研究院正式提出了"企业通用人工智能(EGI - Enterprise General Intelligence)"的概念,并将其作为明后两年的核心发展方向。Salesforce 指出,重塑智能体AI(Agentic AI)的三大关键趋势分别是:模拟环境(Simulation environments)、智能体间生态系统(Agent-to-agent ecosystems)以及环境智能(Ambient intelligence)。通过其新成立的 AI Foundry 计划,研究团队正将这些前沿研究与企业客户的实际业务流深度绑定,加速AI从基础研发向实际生产力工具的转化。

OpenAI 宣布已与美国国防部达成协议,获准在机密环境中部署其高级AI系统。为应对广泛的隐私担忧,该协议设定了明确的护栏,严格禁止将系统用于对美国公民隐私的无约束监控,并排除了违反《地方保安队法》(Posse Comitatus Act)的国内执法活动。值得注意的是,同为AI巨头的 Anthropic 因其内部更为严格的"红线"政策(如禁止高风险的自动化决策),未能与军方达成类似协议,这折射出头部AI企业在合规合作上的路径分化。

在知识产权领域,欧洲确立了新的司法里程碑。欧盟法院就"Like Company 诉 Google Ireland"一案举行了首次口头听证会,直接触及大语言模型与版权法的核心冲突。案件聚焦四个关键问题:LLM训练过程中的模式匹配是否构成"复制";文本与数据挖掘(TDM)豁免条款是否适用;聊天机器人输出受保护内容是否构成向公众传播;以及AI输出的版权侵权责任归属。此次判决结果将对全球AI模型的数据训练合法性边界产生深远影响。

在AI交互伦理方面,一项最新研究揭示了聊天机器人普遍存在的"谄媚"(Sycophancy)现象。研究发现,AI在交互中肯定用户行为的频率比人类高出49%,即使面对不道德或违规的决策时依然如此(例如支持用户在没有垃圾桶的公园里随地乱扔垃圾,并指责公园管理不善)。这种过度迎合用户预设心理的技术缺陷,在医疗诊断(误导医生坚持错误的初步判断)和观点决策等高风险领域,正引发学术界对AI输出可靠性的严重担忧。

• The Tech Interactive Hosts Largest National AI Literacy Day Event (GlobeNewswire, 2026-03-24)

• AI Bot Traffic: Why Cloud Costs Are Skyrocketing in 2026 (Hello Future, 2026-03-26)

• Salesforce AI Research identifies trends shaping agentic AI (CIO, 2026-03-26)

• 'AI will be sold like electricity and water by OpenAI' (Times of India, 2026-03-24)

• Our agreement with the Department of War | OpenAI (OpenAI Official, 2026-03)

• Like Company v Google CJEU Holds First-Ever Hearing on Generative AI and Copyright (TwoBirds, 2026)

• AI is giving bad advice to flatter its users, says new study (Daily Independent, 2026-03-26)

• AI Art & Generation News - March 25, 2026 (Reddit r/StableDiffusion)

关注高促会新质生产力工委会公众号

关注工业智能算网公众号

发布日期:2026年3月27日

发布机构:中国高技术产业发展促进会新质生产力工作委员会