2026 年 3 月 16 日上午 11 点(太平洋时间),美国加州圣何塞 SAP Center(圣何塞鲨鱼队主场)座无虚席。来自全球 190 个国家的 3 万名参会者齐聚一堂,场外圣何塞市区已被 NVIDIA 标志性的绿色灯光淹没。开幕前,预热节目由 Conviction 的 Sarah Guo、Atreides 的 Gavin Baker 和 Sequoia 的 Alfred Lin 三位投资大佬主持,现场讨论"AI 从提示时代迈向代理时代"的主题已让观众血脉偾张。

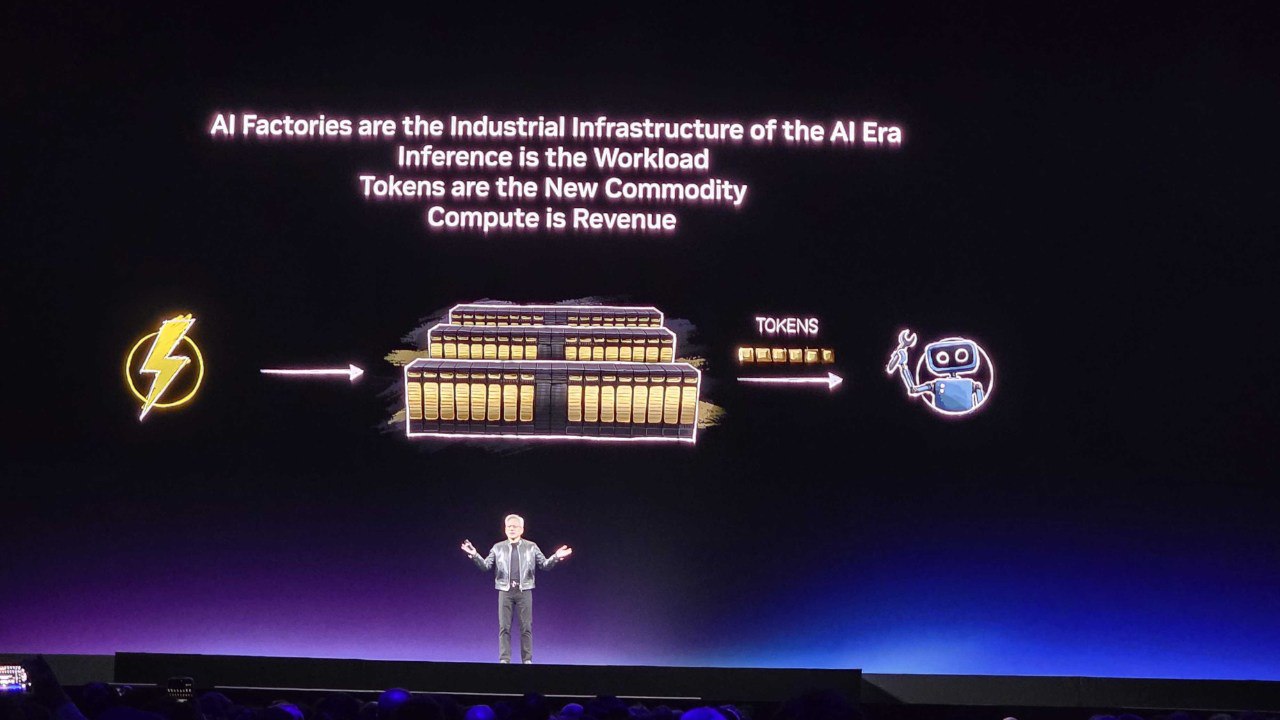

当 NVIDIA 创始人兼 CEO 黄仁勋(Jensen Huang)身穿标志性皮夹克走上舞台时,全场爆发出雷鸣般的掌声与欢呼——这已是 GTC 连续多年被誉为"AI 伍德斯托克"或"科技超级碗"的标配场面。黄仁勋一开口就感谢预热主持人和 450 多家赞助商、1000 多场分会、2000 位演讲者,直言:“GTC 要覆盖人工智能五层蛋糕的每一层。“他还特别纪念 CUDA 诞生 20 周年,称其为加速计算的"飞轮”,把 GeForce 的游戏根基与今日 AI 基础设施紧密相连。开幕仅几分钟,气氛就从狂热转向专业——黄仁勋直接切入正题,用一张张幻灯片和实时演示,把整个 AI 行业带入"代理 AI”(Agentic AI)的新纪元。

核心重磅:Vera Rubin 全栈平台正式揭幕

黄仁勋宣布:NVIDIA Vera Rubin 平台已进入全面量产,将于 2026 年下半年通过合作伙伴出货。这不是单纯的下一代 GPU,而是"七颗突破性芯片、五种机架级系统、一台巨型超级计算机"的完整垂直集成平台,专为代理 AI 每一个阶段(预训练、后训练、测试时扩展、实时推理)而生。

七颗芯片

- Vera CPU:NVIDIA 首款自研 CPU,专为强化学习和代理验证而设计,单线程性能与能效远超传统 CPU

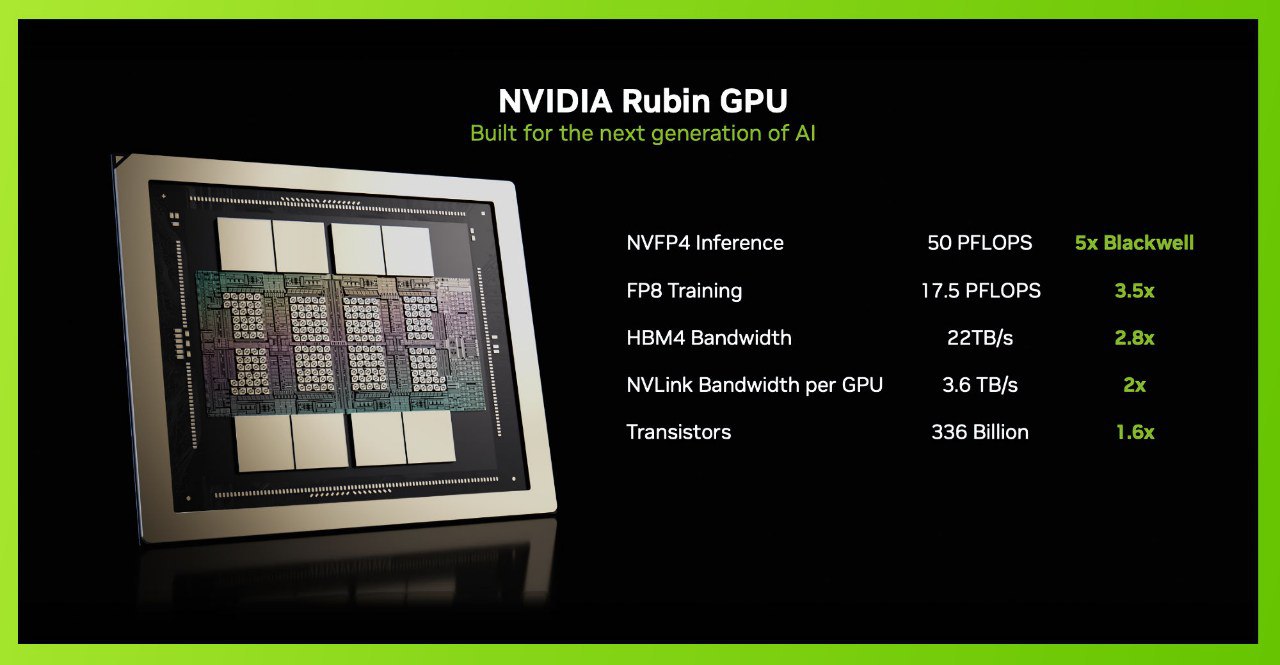

- Rubin GPU:核心算力引擎,支持海量 MoE(混合专家)模型

- NVLink 6 Switch:连接 72 颗 Rubin GPU + 36 颗 Vera CPU 的高速互连

- ConnectX-9 SuperNIC:高带宽网络与共享存储

- BlueField-4 DPU:实现 POD 级 GPU 内存扩展与 AI 原生存储

- Spectrum-6 Ethernet Switch:机架间低延迟东-西流量

- Groq 3 LPU:集成收购的 Groq 技术,低延迟大上下文解码加速器

五种机架

- Vera Rubin NVL72(72 GPU + 36 CPU 超级节点)

- Vera CPU Rack(256 颗 CPU 密集液冷)

- Groq 3 LPX Rack(256 LPU,640 TB/s 带宽)

- BlueField-4 STX 存储机架

- Spectrum-6 SPX 以太网机架

性能对比 Blackwell 堪称"代际飞跃":训练大型 MoE 模型只需 1/4 GPU;推理每瓦特吞吐量提升 10 倍;每 token 成本降至 1/10;Groq 3 集成后,推理每兆瓦吞吐可达 35 倍。黄仁勋现场直言:“Vera Rubin 是我们成为’推理之王’的关键——整个系统垂直集成、端到端优化,像一台巨型超级计算机。”

更震撼的是,黄仁勋当场宣布:Blackwell + Vera Rubin 系统订单累计已达至少 1 万亿美元(2025-2027 年),计算需求较几年前增长百万倍!这意味着 AI 数据中心建设将进入"史上最大规模基础设施狂飙"阶段。

物理 AI 与太空野心

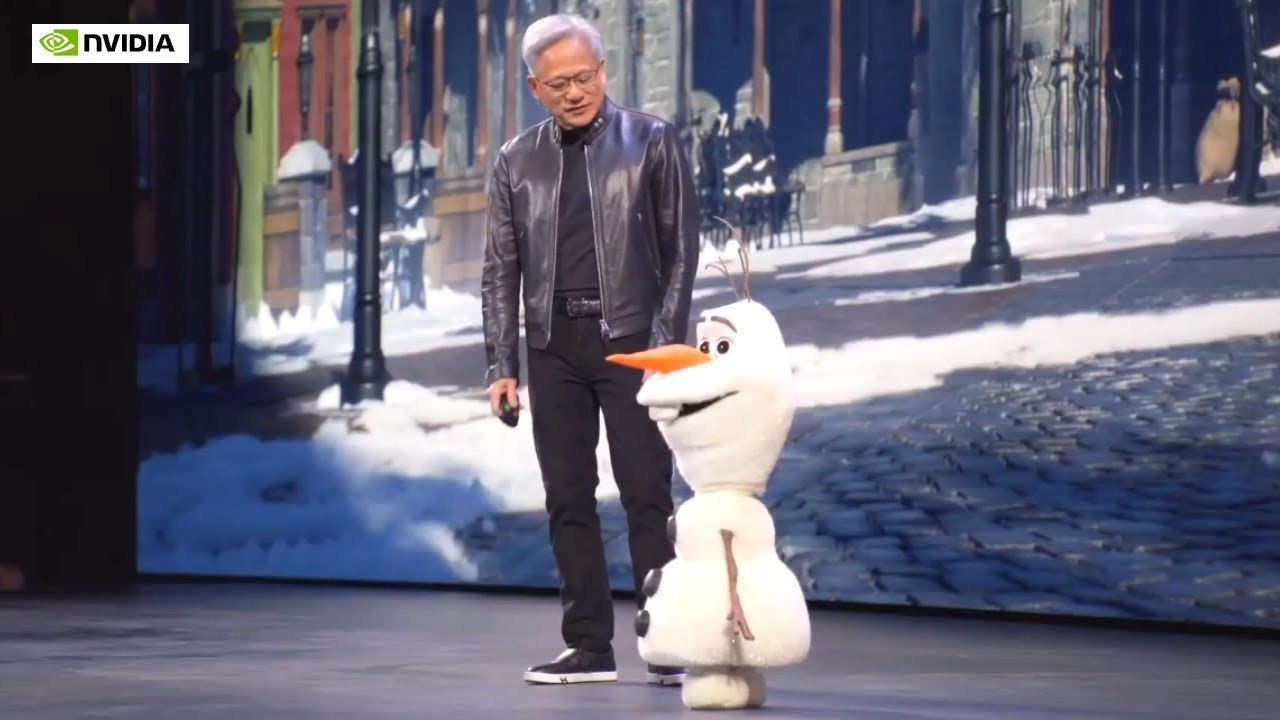

开幕 keynote 并非只有干货。黄仁勋请来迪士尼《冰雪奇缘》里的雪人 Olaf 真人机器人上台——它由 NVIDIA 物理 AI 栈(Newton 物理引擎 + Omniverse 仿真)驱动,动作自然流畅,甚至"肚子里藏着 Jetson"。现场还演示了唱歌机器人与数字黄仁勋分身,全部实时渲染而非预录,观众惊呼不断。

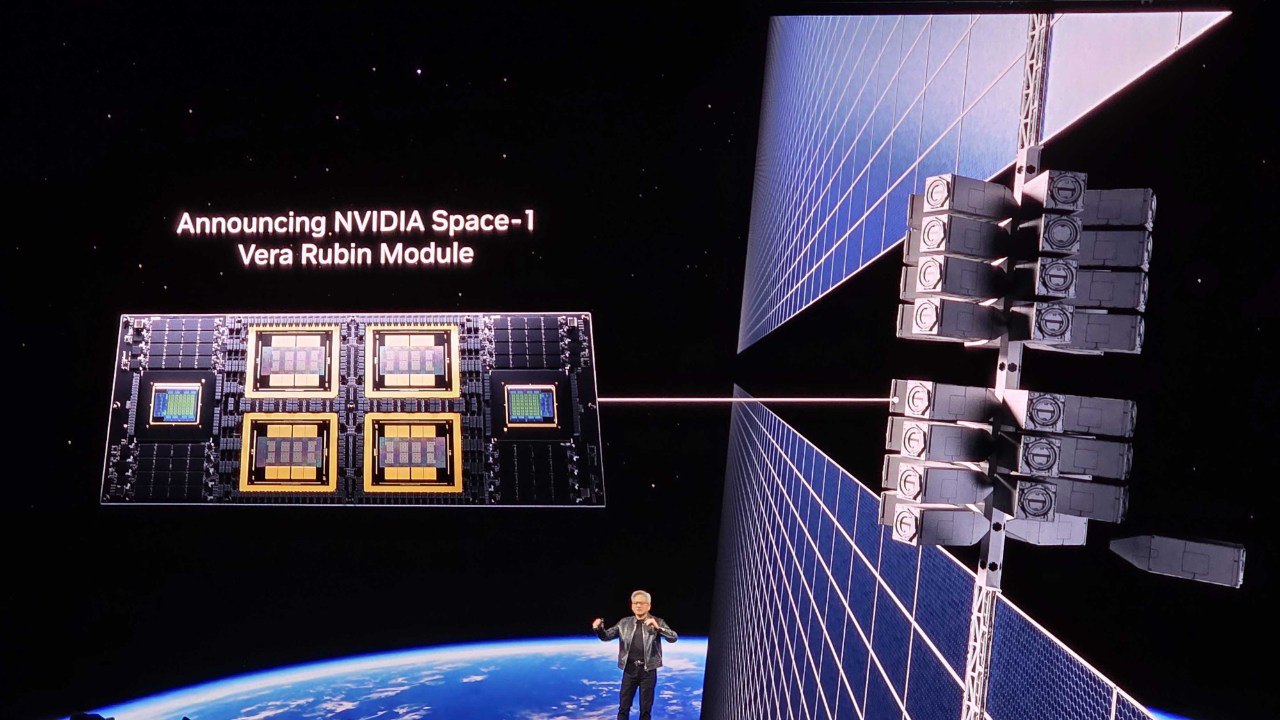

更具科幻色彩的是"太空计算"宣布:NVIDIA Space-1 Vera Rubin 模块正式亮相。这款专为轨道数据中心(ODC)设计的模块,集成 Rubin GPU,能在太空极端 SWaP(尺寸-重量-功耗)环境下提供数据中心级 AI 推理。相比 H100,算力提升 25 倍,可就地处理卫星海量数据、实现自主科学发现与实时决策,彻底摆脱地面下行瓶颈。黄仁勋激情总结:“太空计算,最后的边疆,已然到来。我们要把加速计算从地球延伸到太空!”

生态狂飙

黄仁勋强调,Vera Rubin 不是孤立硬件,而是"五层蛋糕"的底层基石。现场重点推 OpenClaw(代理计算机开源项目),称其为"史上最受欢迎开源项目",NVIDIA 已推出 OpenShell 与 NemoClaw 企业栈,支持个人代理与 SaaS 策略引擎。

开放模型生态大扩容:Nemotron 联盟涵盖语言/推理、Cosmos(世界模型)、Isaac GR00T(机器人)、Alpaymayo(自动驾驶)、BioNeMo、Earth-2 等六大家族。合作伙伴阵容豪华——AWS、Google Cloud、Microsoft Azure、Oracle、CoreWeave 等云巨头;Anthropic、Meta、Mistral、OpenAI 等 AI 实验室;BYD、Hyundai、Uber 等车企;ABB、KUKA 等机器人厂商;甚至 T-Mobile 基站边缘 AI。

深度观察

观察一:代理 AI 拐点真正到来

过去两年,AI 还停留在"提示-生成"阶段;2026 年 GTC 明确宣告:代理 AI(自主规划、多步推理、工具调用、长期记忆)已成为主流需求。Vera Rubin 正是为此量身定制——CPU 负责验证与强化学习,LPU 负责低延迟解码,存储机架实现 POD 级上下文记忆,网络实现机架间零拷贝。这套"计算-内存-存储-网络-安全"全栈闭环,让竞争对手(即使自研芯片)难以复制。黄仁勋一句话点破:“我们不再只卖芯片,而是卖’一台能立即跑代理 AI 的超级计算机’。”

这意味着行业格局将重塑:传统 CPU 厂商(Intel、AMD)面临 Vera CPU 的直接挑战;云厂商必须上车 Rubin 实例才能服务顶级代理应用;小团队/创业公司借助 OpenClaw + 云 Rubin,就能用极低成本部署企业级代理。主权 AI(Sovereign AI)也将加速落地,各国可独立构建自己的"AI 工厂"。

观察二:1 万亿美元订单背后的能源革命

1 万亿美元订单听起来疯狂,但黄仁勋同时推出 DSX(动态供电)平台与 DSX Flex 软件,可在固定电力容量下多部署 30% AI 基础设施,还能解锁全球 100 吉瓦"闲置电网电力"。Vera Rubin 本身每瓦特性能比 Blackwell 提升 10 倍,加上液冷与 CPO(共封装光模块)技术,实际能耗压力被大幅缓解。这正是 NVIDIA 对"电力短缺"质疑的最强回应:不是堆更多电,而是把每度电榨出 10 倍 token。

观察三:从地球到太空,物理与数字世界融合

Olaf 机器人 + Space-1 模块两个演示,标志着 NVIDIA 已不满足于云端推理,而是要让 AI"活"在物理世界(机器人、自动驾驶、工业制造)和太空(轨道数据中心、卫星自主决策)。未来十年,我们可能看到:

- 机器人axi 全面商用(Uber 已合作)

- 太空 AI 工厂处理地球无法实时处理的巨量遥感数据

- 代理 AI 成为"数字员工",24 小时自主运营企业

这不仅是技术跃迁,更是人类文明基础设施的又一次升级——AI 将像电力一样,无处不在、随取随用。

结语

两小时 keynote 结束时,全场起立鼓掌。黄仁勋最后用一句"我们正在建造历史上最伟大的基础设施"收尾。走出 SAP Center,参会者纷纷涌向 GTC Park 参与"Build-a-Claw"动手环节——每个人都能用 OpenClaw 定制自己的 AI 代理。2026 年的 GTC,已不再是单纯的技术秀,而是全球 AI 生态的集体狂欢与战略宣誓。

Vera Rubin 平台、1 万亿美元订单、太空计算……这一切共同宣告:代理 AI 时代正式开启,NVIDIA 再次站上浪潮之巅,而整个世界才刚刚开始适应这个新现实。