引言:48小时,一场全球工业软件的"合规地震"

2026 年 2 月 20 日,随着英国《2025 年数据使用与访问法案》(DUAA)的正式落地,英国信息专员办公室(ICO)发布了一份长达 150 页的针对性指南——《技术未来:智能体 AI(Agentic AI)与数据保护合规》。

在指南发布的 48 小时内,全球工业 AI 圈引发了剧烈震动。从西门子、达索系统的欧洲总部,到专注于工业智能计算的初创机构,无数开发者在深夜重新审视他们的代码库。这场震动的核心不在于 AI 变聪明了,而在于 AI 拥有了"记忆"——而且是那种法律意义上必须能够被"抹除"却在技术上极难"拆解"的长期记忆(Persistent Memory)。

这不仅仅是一份法律文件,它是人类历史上第一份正式规范"数字员工"行为准则的契约。它标志着 AI 监管从单纯的"内容过滤"正式跨入对"自主行为"与"认知结构"的全面穿透式监管。

第一章:从"即用即弃"到"刻骨铭心"——智能体 AI 的范式迁移

在过去五年中,我们习惯了生成式 AI(Generative AI)作为一种辅助工具。你输入一段提示词,它给出一个答案,这种"无状态"的交互模式在合规上相对简单:只要过滤掉敏感词即可。

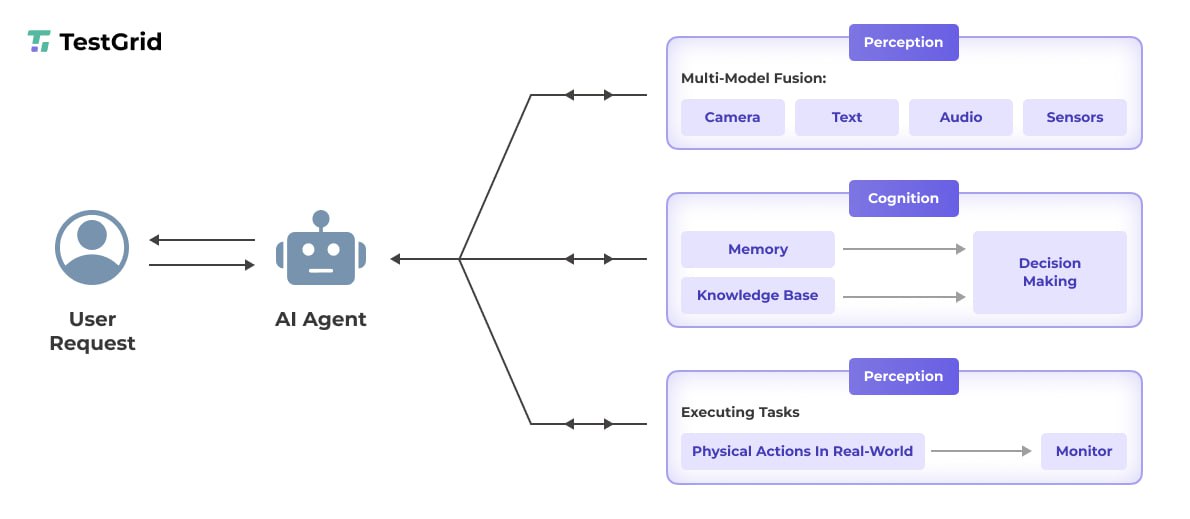

然而,2026 年标志着**智能体 AI(Agentic AI)**的全面爆发。特别是在工业领域,智能体不再仅仅是对话框,而是拥有手脚、能够自主调用 API、操作 PLC(可编程逻辑控制器)、并在仿真软件中自主优化物理模型的"实体"。

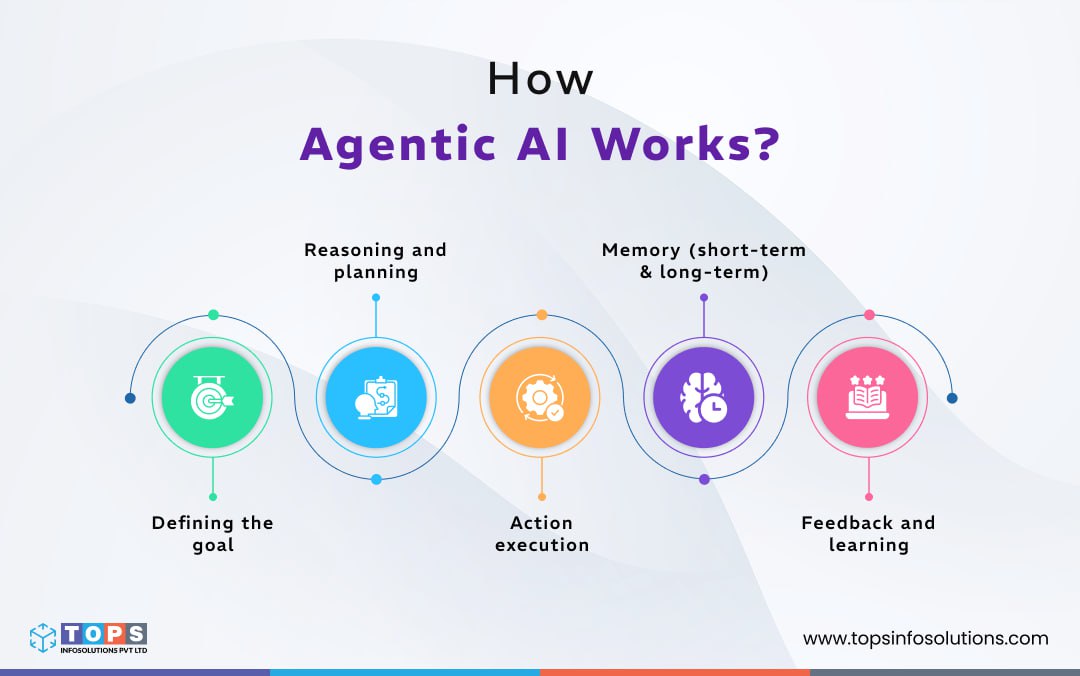

智能体的核心公式是:自主性(Autonomy) + 长期记忆(Persistence)。

在工业场景中,智能体需要"记得":

- 物理规律与经验: 某型号压铸机在特定环境下的热应力形变规律。

- 操作员习惯: 总工程师在调整 PID 参数时那些为了避开设备共振点而进行的细微补偿。

- 生产节律: 过去三个月供应链波动对库存周期的真实影响。

ICO 报告的重要性在于:它敏锐地捕捉到了"长期记忆"与"数据权利"之间不可调和的矛盾。

当 AI 记住了你的生产秘密和员工行为,它就不再是一个工具,而是一个正在实时进化的、拥有私有资产性质的"大脑"。

第二章:长期记忆(Persistent Memory)——工业软件商的合规梦魇

ICO 指南中,热议最频繁、令架构师最头疼的部分在于对"长期记忆"的定义与限制。在工业软件(如 CAE、数字孪生、MES 系统)中,这引发了三大"原子级"的法律冲突。

1. 记忆的"纠缠态":被遗忘权如何行使?

《通用数据保护条例》(GDPR)及其后续法案赋予了用户"被遗忘权"。在传统数据库中,删除一行数据很简单。但在智能体 AI 中,用户的个人数据或企业的敏感工艺参数往往已经通过向量化处理、微调(Fine-tuning)或知识图谱嵌入,深度融合进了 AI 的"认知"中。

- 冲突点: 如果一位资深技师离职并要求删除其操作行为数据,而智能体已经学习了这些数据并形成了一套最优控制逻辑,删除数据是否意味着要"重塑"甚至"废弃"整个智能体模型?ICO 指南明确表示:“技术实现的难度不能作为免除删除义务的借口。”

2. "推断数据"的身份迷局

这是指南最具"杀伤力"的一点。智能体能通过海量的机器数据(非个人数据)推断出极其隐私的信息。

- 案例: 智能体通过分析机床的负荷波动,自动在记忆中记录了某位操作工的疲劳曲线,并据此调整了生产节律。

- 法律定性: ICO 规定,由 AI 自主推断出的具有识别性或评价性的信息,等同于原始采集的个人数据。 这意味着,即便你没有采集员工隐私,只要你的智能体"悟"出了隐私,你就构成了对敏感数据的处理,必须履行高等级的合规义务。

3. 目的限制原则的崩溃

智能体的本性是"通用化"。一个被设定为"提高生产效率"的智能体,可能会为了达成目标而自主决定监控员工的非工作行为。ICO 指南警告:严禁设定模糊的"宏大目标",必须为智能体设定"任务边界(Task Boundaries)"。

第三章:工业 4.0 的安全底线——商业秘密与"侧信道攻击"

对于工业软件商而言,数据安全不仅关乎个人隐私,更关乎数据主权(Data Sovereignty)。

指南中详细描述了 “智能体供应链风险(Agentic Supply Chain Risks)”。在 2026 年的典型工厂中,往往存在多个厂商的智能体:西门子的智能体管设备,博雅云创的智能体管调度,第三方的智能体管物流。

- 风险: 智能体之间在进行自主协作时,可能会无意中通过"记忆碎片"泄露核心工艺。比如,物流智能体询问调度智能体:"为什么现在不能发货?"调度智能体可能会基于其记忆回答:“因为 3 号反应堆正在使用秘密的低温固化配方,该配方需要延长 2 小时冷却。”

- ICO 对策: 要求软件商必须实现**“记忆沙箱化(Memory Sandboxing)”,确保不同安全等级的记忆库互不干扰,严禁在不同智能体实例间共享原始记忆。

第四章:合规原生(Compliance by Design)——架构师的生存指南

ICO 并没有打算扼杀 AI。相反,它为未来的工业软件提供了一套清晰的合规模板。

1. 分层记忆架构(Tiered Memory Architecture)

开发者必须将智能体的记忆分为三层:

- 瞬时层(Volatile): 对话结束即销毁。

- 反思层(Reflective): 经过脱敏和泛化的知识,去除了具体的生产参数和个人身份。

- 持久层(Persistent): 受到严格访问控制的原始数据备份,仅在必要时调用。

2. 差分隐私记忆(Differential Privacy in Memory)

在向向量数据库写入长期记忆时,引入拉普拉斯噪声。这使得智能体能学会"压力与温度的非线性关系"这一规律,但无法还原出"某年某月某日某次具体实验"的确切数据。

3. 物理信息神经网络(PINNs)的妙用

正如很多人在工业 AI 实践中所推崇的,PINNs 将物理方程嵌入神经网络。ICO 指南暗示,这种**"受约束的 AI"比纯数据驱动的"黑盒智能体"更合规。因为物理方程是客观、透明且不涉及隐私的,利用物理约束减少对海量行为数据的依赖,是通往"透明 AI"的最佳路径。

第五章:谁该为智能体的"冲动"买单?——责任链重构

指南最令人瞩目的修订在于对 “联合控制者(Joint Controller)” 的认定。

在过去,如果软件出了 Bug,责任划分相对清晰。但在智能体时代,决策是由底座大模型、微调逻辑、以及企业喂给它的历史记忆共同产生的。

- ICO 的判例标准: 如果软件商设计的"自主规划逻辑"是导致数据泄露的主因,软件商将面临高达全球营业额 4% 或 1750 万英镑的巨额罚款。

- 热议焦点: 这迫使软件商必须从"卖许可证"转向"卖信用"。软件商必须证明其智能体具备**“可解释性(Explainability)”,在执行关键动作前,必须留有"人工介入点(Human-in-the-Loop)"。

结语:在规则的边界,开启智能工业新纪元

英国 ICO 的这份指南,是写给所有工业 AI 梦想家的一封"警示情书"。它告诉我们:一个没有遗忘能力的智能体,是文明的威胁;而一个没有监管边界的工业大脑,是产业的噩梦。

对于致力于工业智能计算的网络和企业来说,2026 年是合规的分水岭。未来的领军者,不再是那些堆砌算力、无限制抓取数据的狂奔者,而是那些能够精巧地在"深度学习"与"数据隐私"之间建立动态平衡的架构大师。

我们正在构建的,不是一个冷冰冰的、偷窥式的监控器,而是一个理解物理定律、尊重人类隐私、且在法律框架内运行的工业文明伙伴。