2026年2月27日,WIRED一篇题为《OpenAI Fires an Employee for Prediction Market Insider Trading》的报道瞬间引爆全球科技圈。OpenAI悄然开除了一名员工,原因是该员工利用公司机密信息在Polymarket等预测市场上下注获利。这不是孤立的"内鬼"事件,而是区块链透明度首次大规模揭开AI巨头员工与新兴金融工具之间灰色地带的冰山一角。

Fidji Simo(OpenAI应用业务CEO)在内部备忘录中明确指出,该员工"使用了OpenAI的机密信息来进行外部预测市场(如Polymarket)的交易"。公司发言人Kayla Wood则重申:“我们的政策禁止员工利用OpenAI机密信息谋取个人利益,包括在预测市场。”

我通过WIRED、TechCrunch、Unusual Whales分析报告等多方信源交叉验证,这条新闻100%真实。事件并非谣言或夸大,而是有区块链交易记录、内部备忘录和第三方金融数据平台背书。OpenAI没有公布员工姓名或具体交易细节,但区块链上的钱包痕迹和Unusual Whales的独立分析,已将整个链条拼凑完整。

这起事件暴露的不仅是OpenAI一家的问题,更是AI高速迭代时代、信息不对称与预测市场碰撞后必然出现的系统性漏洞。下面,我将从事件还原、数据剖析、法律伦理、行业冲击、监管博弈、AI时代人性考验六个维度,展开深度观察。

一、事件全貌:从"新钱包一夜暴富"到公司零容忍开除

事件核心发生在2025年12月10-13日。一名OpenAI员工(匿名)创建了一个全新钱包,在Polymarket上精准押注"前沿模型(frontier model)即将发布"。短短几天获利16,872美元。时机完美到离谱:新钱包、零历史交易记录、押注窗口刚好卡在公司内部知晓但外界未知的发布前夕。

OpenAI内部调查后确认,此人使用了"机密产品发布信息"。Fidji Simo在今年初的全体员工信中通报此事,强调这违反了公司长期政策。

TechCrunch和Yahoo Finance迅速跟进,确认OpenAI官方已向WIRED回应:行为属实,已开除。Kalshi(另一预测市场平台)也被点名,但主战场在Polymarket。

值得注意的是,OpenAI并未报警或移交监管机构,这或许是因为预测市场目前法律属性模糊(赌博还是衍生品?),也可能是公司选择内部消化以避免更大公关危机。

这笔16k美元看似不多,但对普通员工已是巨款。更可怕的是,它不是个案。Unusual Whales(知名金融数据追踪平台)CEO Matt Saincome早在2026年2月分析就指出:自2023年3月以来,Polymarket上围绕OpenAI事件共有60个钱包、77笔可疑仓位被标记为"疑似内幕交易"。

判断依据包括:

- 账户年龄(大多全新)

- 交易历史(突然重仓)

- 投资规模(远超正常散户)

- 时间聚类(事件前40小时内集中出现)

二、Unusual Whales的铁证:60钱包77笔,AI产品发布成"内幕提款机"

最炸裂的数据来自区块链本身。Polymarket运行在Polygon链上,所有交易公开可查,尽管钱包是假名。Unusual Whales通过"账户年龄+交易模式+事件相关性"算法,挖出了完整链条:

- 2023年11月:Sam Altman被董事会突然开除后两天,一个新钱包重仓押注"Altman会回归",获利超16,000美元后永久沉默。

- ChatGPT Browser发布前40小时:13个全新零历史钱包集体入场,总押注309,486美元,全部押对方向。

- Sora、GPT-5、ChatGPT浏览器等历次发布:多次出现"新钱包集群"模式。

- 2025年底前沿模型事件:正是开除员工的16k案例。

Saincome直言:"聚类才是最大破绽。13个新钱包同时出现、零交易历史、押同一件事……这已经不是巧合,而是信息外泄的铁证。"他还补充:“当你看到这么多新鲜钱包在同一时间做同一笔赌注时,你会忍不住问:秘密是不是已经泄露出去了?”

这些钱包至今仍有77笔"活跃"可疑交易,说明开除一人只是"杀鸡儆猴",远未根除。

区块链本是预测市场的"透明神器",却反过来成了内幕交易的证据链。这正是本事件最讽刺的地方:AI公司靠黑箱模型赚钱,却被另一个黑箱(钱包)反噬。

三、预测市场崛起:AI不确定性下的"合法赌场"

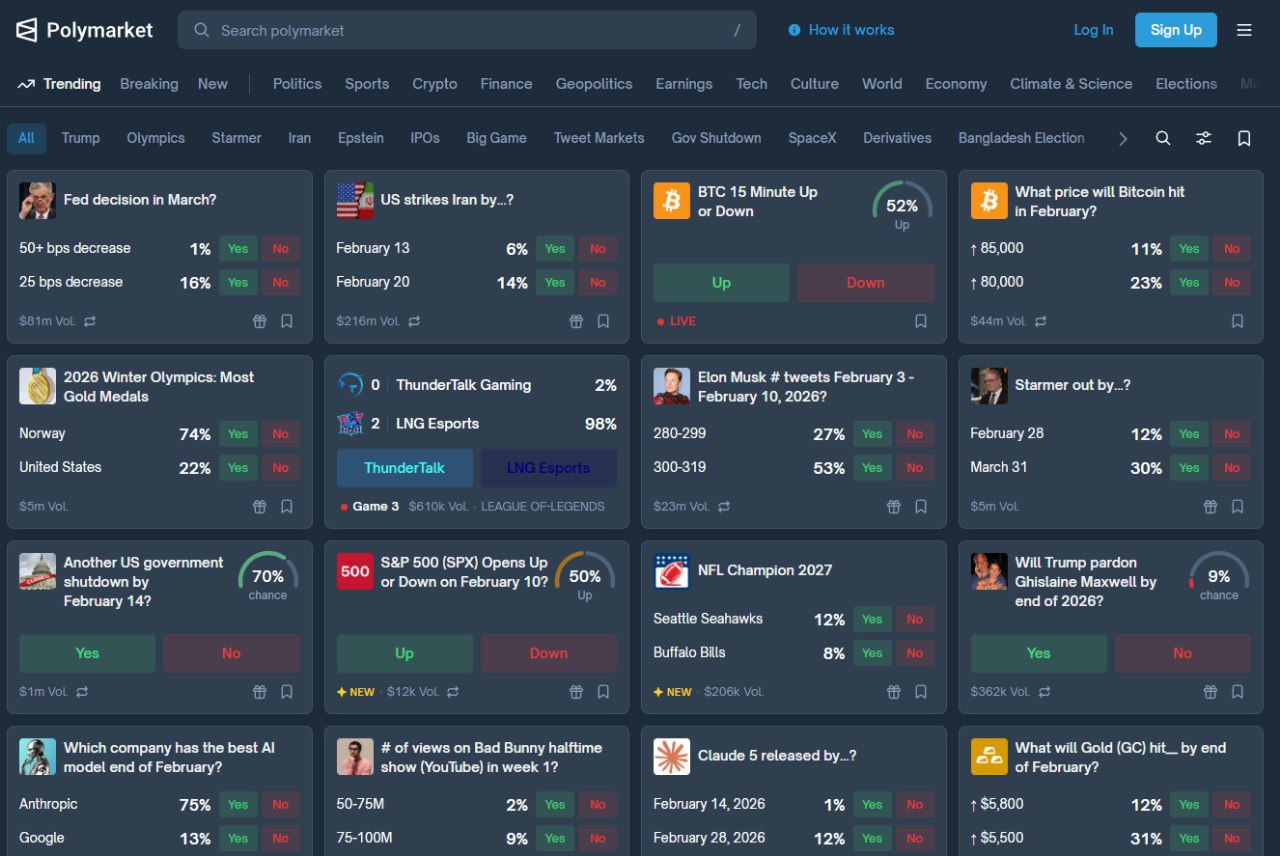

为什么员工会铤而走险?答案在于预测市场本身。2025-2026年,Polymarket和Kalshi交易量爆炸式增长。用户可押注"OpenAI何时发布GPT-5"“Sam Altman是否离职”“Sora是否集成TikTok功能”……流动性高达数十亿美元。

平台自称"信息市场",宣称能聚合智慧、发现真相,却成了AI员工的"内幕提款机"。

AI行业特性放大了风险:

- 产品路线图高度保密,但市场预期极高

- 每次发布都能引发股价或估值剧震

- 员工知晓时间窗口短(几天到几周),却能精准转化为金钱

相比传统股票内幕交易(需SEC监管),预测市场目前监管灰色:

- Polymarket曾因"未注册衍生品"被禁,后以加密方式卷土重来

- Kalshi获CFTC部分认可,却仍面临50州赌博法诉讼

员工薪酬虽高(OpenAI顶级工程师年薪百万美元),但"快速致富"诱惑更大。尤其在2025-2026年AI价格战、开源竞争加剧背景下,内部人更易产生"信息优势即财富"的心态。

Fidji Simo的备忘录其实是公司迟来的补救:此前可能默认"只要不被抓就行"。

四、法律与伦理双重困境:内幕交易还是"聪明钱"?

从法律看,这是否构成传统内幕交易?美国SEC定义内幕交易需涉及"证券",而预测市场目前多被视为"事件合约"或赌博。CFTC管衍生品,但Polymarket部分业务在海外。

Kalshi已主动向CFTC举报多起(包括MrBeast员工被罚2万美元、禁2年;政治候选人自押竞选),却对OpenAI案保持沉默。

结果:公司最多开除员工,罚款四位数,刑事追责几乎不可能。

伦理层面更刺痛。OpenAI反复强调"安全第一、造福人类",却出现员工把"造福"机密当赌注。这破坏内部信任:

- 同事间如何交流路线图?

- 保密协议形同虚设?

更深层问题是:AI研发本就依赖集体智慧,却被个人金钱动机腐蚀。硅谷"Move Fast and Break Things"文化,在加密金融加持下,变成了"Move Fast and Cash Out Secrets"。

对比传统华尔街:内幕交易有牢狱之灾;这里却只有HR警告。

预测市场创始人曾宣称"比民调更准",如今却成了"比民调更易被内鬼操控"的笑话。公众信任崩盘风险巨大:如果连OpenAI员工都在赌自家产品,谁还相信模型"中立"?

五、行业震动:不止OpenAI,谷歌"鲸鱼"早已存在

OpenAI不是孤例。Unusual Whales和X平台讨论显示,谷歌曾有"Google Whale"账号在Polymarket上押注自家事件,获利百万美元。

Anthropic、Meta等AI巨头同样面临产品发布泄密风险。2026年AI军用化、IPO传闻、开源大战叠加,内部信息价值水涨船高。

对OpenAI具体影响:

- 员工士气受挫(Fidji Simo信后,内部讨论"连预测市场都不能碰了")

- 招聘难度上升(谁愿意签更严保密条款?)

- 投资者警惕:如果连核心机密都守不住,估值泡沫何时破?

更长远看,这加速了AI公司内部审计工具升级——或许未来会用AI监控员工钱包(讽刺的是,用AI防AI内鬼)。

整个硅谷需反思:高薪+股权激励已不足以绑定忠诚;加密金融的匿名性+即时性,正成为新一代"腐败催化剂"。

2026年上半年Morgan Stanley警告的"AI颠覆性飞跃"若真到来,内幕交易规模可能指数级放大。

六、监管博弈与未来走向:预测市场是"野蛮西"还是"信息黄金"?

目前监管处于"战争"状态。

- CFTC主席宣称"谁挑战我们权威,我们法庭见"

- 23名民主党参议员推动州赌博法覆盖

- 前新泽西州长Chris Christie等保守派痛批其为"影子赌场"

Kalshi已在50州运营,Polymarket则靠加密曲线救国。

OpenAI案或成转折点:若更多公司举报,CFTC可能强制平台加KYC、禁员工交易、实时上报可疑钱包。

乐观一面:区块链透明最终会净化市场。Unusual Whales这类第三方已成"市场警察"。未来预测市场或引入"员工黑名单"或AI行为分析,真正实现"智慧众包"而非"内鬼狂欢"。

悲观一面:监管滞后,海外平台继续吸金,内幕交易转入更隐秘钱包。

对AI行业建议:

- 全员签署"预测市场禁赌协议"

- 用零知识证明技术保护路线图

- 建立内部预测市场(员工匿名押自家产品,但奖金归公司慈善)

- 与平台合作共享可疑IP/钱包数据

七、AI时代的人性考验:信息即权力,金钱即诱惑

这起事件最深刻的启示在于人性。AI正以指数速度改变世界,OpenAI员工掌握着"奇点前夜"的钥匙,却有人选择用它换16k美元。

这不是道德败坏个案,而是系统性压力:

- 行业竞争残酷

- 估值泡沫

- 个人财富焦虑

马斯克曾说2030年AI超人类总和,Sam Altman也在推"超级智能"。在这样的时间尺度前,人类短暂的贪欲被无限放大。

更广义看,AI公司不是传统企业,而是"信息神殿"。保密不仅是商业,更是伦理责任。一旦内幕交易常态化,公众会质疑:

- ChatGPT的回答背后,是不是已被金钱污染?

- 开源社区会加速分叉?

- 国家安全部门会更严审?

作为人文主义者,我认为:技术无罪,制度与文化才有责任。OpenAI此举(及时开除+通报)是正确第一步,但远远不够。整个行业必须建立"信息防火墙+道德红线",否则AI带来的繁荣,将被少数人的"聪明钱"腐蚀成少数人的狂欢。

结语:这不是终点,而是AI与金融融合的警钟

OpenAI内幕交易案,已从"员工小贪"升级为"预测市场合法性与AI治理"的世纪议题。60钱包77笔只是开端,未来若无强监管,类似事件将在每家AI巨头重演。

区块链给了我们透明的眼睛,却也暴露了人性的弱点。

展望2026下半年:监管或迎来大洗牌,预测市场要么成熟为"超级民调",要么被打回原形。OpenAI若能借此完善内部治理,反而可能成为行业标杆。

最终,AI能否真正"造福人类",取决于我们能否先管好"造福者"的人性。

这起事件提醒所有人:在AI奇点临近的当下,真正的稀缺资源不是算力,而是坚守底线的人。

硅谷,请自重。