在2026年3月的这个节点,福布斯与各大金融媒体披露的Meta与NVIDIA"深度捆绑"消息,标志着生成式AI正式从"大模型竞赛"进入了"算力平权与架构跃迁"的第二阶段。

这不仅仅是一次简单的硬件采购协议(尽管金额可能高达数百亿美元),它更像是一场关于"推理成本定价权"的突袭。当单Token推理成本实现35倍的断崖式下跌,AI行业的底层逻辑、商业模式乃至软件架构,都将发生如同从"拨号上网"到"百兆光纤"般的范式转移。

以下是对这一新闻及其背后技术逻辑的深度观察。

一、推理成本的"摩尔定律时刻":35倍削减背后的技术硬核

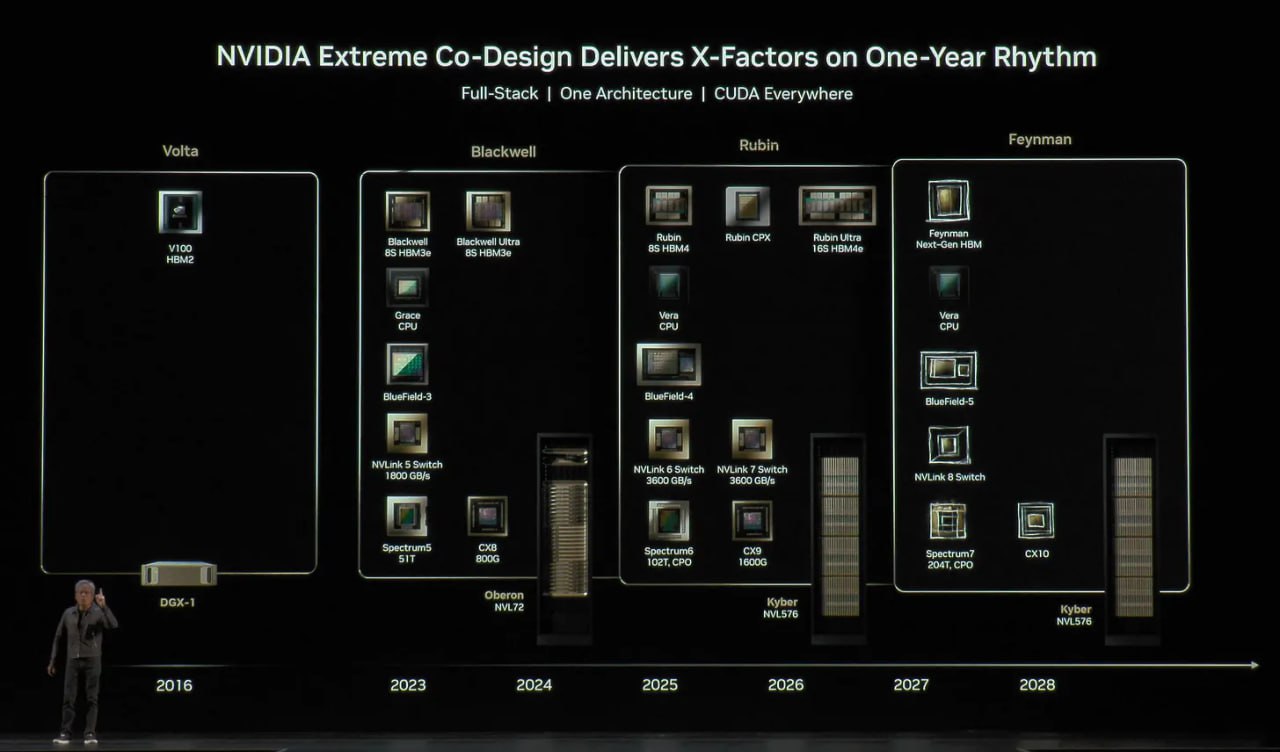

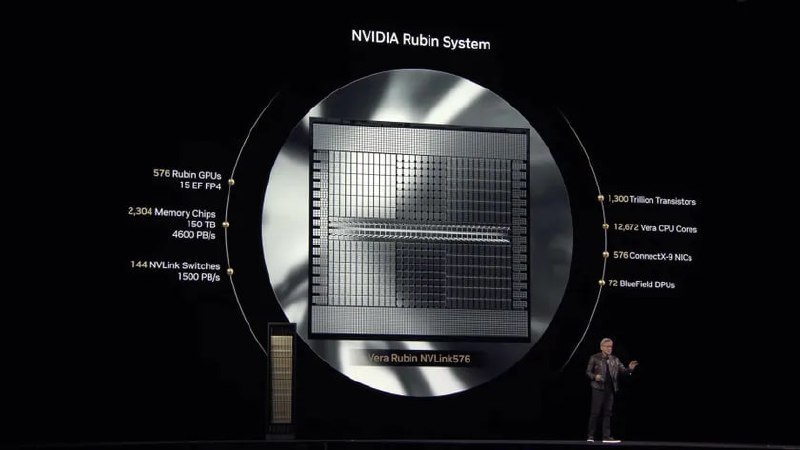

要理解"35倍"这个数字的震撼力,我们必须拆解NVIDIA Blackwell Ultra(GB300)与Rubin架构在精度缩放上的"暴力美学"。

1. 从FP8到FP4:精度与性能的惊险平衡

在过去两年中,FP8(8位浮点数)是推理的主流。但在2026年,随着**NVFP4(NVIDIA 4-bit Floating Point)**的成熟,推理效率实现了质变。

- 核心逻辑:FP4理论上能提供比FP8高出一倍的吞吐量,但传统的4-bit量化会导致模型精度(尤其是推理能力和长文本逻辑)大幅缩水。

- Blackwell Ultra的突破:NVIDIA引入了**“双层动态精度缩放”(Two-level Micro-block Scaling)**。它不再对整个张量进行统一量化,而是以16个元素为一个小块(Micro-block),每个小块拥有独立的高精度缩放因子。这意味着在FP4的存储密度下,它能保留接近FP16的数值动态范围。

- 结果:计算吞吐量翻倍,同时由于内存带宽需求减半(权重减小),单块显卡能承载的模型参数量提升了2倍,综合推理效率在Transformer Engine的优化下,配合Blackwell Ultra巨大的288GB HBM4带宽,最终在大规模集群中实现了35倍的成本缩减。

2. Transformer Engine的"自动驾驶"

NVIDIA最新的Transformer Engine已经能够实现纳秒级的动态精度切换。在模型推理时,对于那些非关键的注意力头(Attention Heads)或浅层网络,系统会自动降级到FP4甚至更低,而对于逻辑推理密集的关键层,则实时切换回高精度。这种"按需分配"的算力逻辑,是35倍降幅的软件支柱。

二、"代币廉价化"对软件架构的彻底重构:从吝啬到挥霍

过去三年,所有AI开发者都在玩一种"文字游戏":如何通过Prompt Engineering节省Token,如何压缩上下文,如何用RAG替代长文本。

35倍成本削减意味着"Token节约时代"的终结,"Token挥霍时代"的开启。

1. 重型架构:多Agent并行协作(Multi-Agent Parallelism)

在Token昂贵的年代,开发者倾向于"线性推理"——用户问,模型答。

在Blackwell Ultra / Rubin时代,由于成本极低,**“冗余计算”**变成了可接受的策略:

- 群体智能(Swarm Intelligence):针对一个简单任务,后台可以同时启动10个具有不同Persona(角色)的Agent。它们不再是串行工作,而是并行生成多个方案,再由一个"裁判Agent"进行验证和归并。

- System 2思维的落地:为了提高准确率,模型可以进行成百上千次的内部"思考(Chain of Thought)"。以前让模型思考10步可能需要1美分,现在只需要0.03美分。

2. 软件不再是LLM的包装,LLM是软件的内核

2026年的AI软件将不再只是一个对话框。得益于Meta与NVIDIA的深度捆绑,Meta旗下的Llama 5(及后续版本)将针对Blackwell的硬连线指令集进行原生级优化。这意味着AI不再是"调用一个API",而是像CPU指令一样,实时、高频地嵌入到UI的每一个微小动作中。

三、Meta的野心:AI时代的"去中心化OS"

福布斯披露的深度捆绑,揭示了Mark Zuckerberg的核心战略:利用极致的推理性价比,让Meta成为AI时代的通用基础设施。

1. 垂直整合:Meta版的"Wintel"联盟

正如当年的Windows绑定Intel,Meta正在通过以下路径建立霸权:

- 硬件共建:Meta参与了Blackwell Ultra乃至Rubin架构中关于推理优化的规格定义。Meta是全球最大的H100/B200买家,这种规模让它拥有了影响芯片物理设计的权力。

- 算力过剩带来的生态红利:当Meta能够以极低成本运行Llama模型时,它就可以向开发者提供近乎免费的顶级模型推理服务。这直接切断了OpenAI等闭源厂商通过API授权获取暴利的路径。

2. 社交媒体向"Agent网络"的进化

Meta拥有的40亿用户,是最大的"Agent试验场"。35倍的成本下降,支撑了WhatsApp、Instagram上的每一个用户都能拥有一个"永久在线、实时响应"的数字分身。这些Agent需要24小时不断地抓取信息、预处理数据并进行交互——这种高并发、长连接的重型架构,只有在Token成本忽略不计时才具备商业可行性。

四、行业震荡:谁是赢家,谁是祭品?

这次"深度捆绑"是AI行业的一道分水岭。

赢家:

- NVIDIA:成功地将硬件销售转化为生态绑定。Rubin平台的推出,通过HBM4和NVLink 6锁死了高性能计算的护城河,让竞争对手(如AMD、Intel)即便在算力上追赶,也无法在"推理成本/生态兼容性"上抗衡。

- Meta:通过开源与硬件溢价,成功将AI模型变成了"公用事业",自己掌握了水龙头。

输家:

- SaaS套壳公司:那些仅仅靠"调用GPT-4接口、做个前端UI、赚取Token差价"的公司将集体阵亡。当原生推理成本降到尘埃里,这种商业模式将彻底失去价值。

- 算力贫民:无法获得Blackwell Ultra / Rubin集群支持的中小厂商,将面临35倍的代差。这不仅是钱的问题,而是算法架构上的断代——你还在精打细算做串行,别人已经在玩万级Agent并发。

五、总结与深度观察:AI的"宽带时刻"已至

2026年3月的这一披露,实际上向世界宣告:AI的探索期结束了,工业化大规模生产期开始了。

35倍的成本削减,其意义不亚于从昂贵的离线计算向即时云计算的转型。它彻底解决了AI落地中最大的痛点:“账算不过来”。当成本不再是约束,人类的创造力将释放出极其诡谲、繁复的"重型Agent软件"。

未来一年,我们将看到AI软件架构的"暴力化"趋势:模型会变得越来越大,推理路径会变得越来越长,Agent之间的通信会变得极其频繁。而Meta与NVIDIA,正站在这个新世界的制高点上,俯瞰着那些还在试图用"节约Token"来生存的过往。