2026年3月4日,一则看似低调的融资消息在硅谷和制造业圈子炸开。OpenAI前首席研究官Bob McGrew的新公司Arda,正在以7亿美元估值募集7000万美元。领投方是Founders Fund和Accel,Khosla Ventures和XYZ Venture Capital跟投。这不是又一家聊大模型的AI初创,而是直奔"物理世界"的狠角色:用工厂监控视频训练机器人,实现从感知到决策再到执行的全链路自治。McGrew给公司取名Arda——托尔金《指环王》里"世界"的意思。他想做的,就是把AI从云端聊天框里拽出来,让它真正住进工厂的钢筋混凝土里。

我这两天把公开报道、McGrew过往访谈、以及物理AI领域的最新论文都翻了个遍,越看越觉得这不是简单的机器人升级,而是工业大模型的下一个临界点。传统机器人靠规则、靠仿真、靠工程师手把手编程;Arda要让任何一家工厂的监控录像变成可复制的"机器人大脑"。一旦成功,lights-out工厂(无人灯厂)将从科幻变成标配,亚洲那些已经接近99.8%精度、节能40%的生产线,只是预热。西方制造业,也可能借此扳回一城。

Bob McGrew:从PayPal到OpenAI的物理AI老兵

先说说Bob McGrew这个人。他不是典型的AI实验室学者,而是从真实战场走出来的"老兵"。上世纪90年代末,他是PayPal早期员工,那时候公司还在为反欺诈头疼,他参与了最早的实时风险系统。2004年,他成了Palantir的第二位工程师,亲手写了Gotham平台的第一版后端——那个后来帮情报机构和企业处理海量异构数据的怪物系统。他在Palantir干了十几年,从工程师一路升到产品和工程负责人,亲眼见过"数据+算法"如何把混乱的现实世界结构化。

2016年,他跳槽OpenAI,干了整整八年,做到首席研究官(CRO)。OpenAI内部人称他为"把ChatGPT从实验室推向世界的推手之一"。更重要的是,他后来负责的正是"让AI走进物理世界"的项目——训练机器人完成真实任务。2024年那波离职潮里,他和Mira Murati、Barret Zoph一起离开。外界猜测他早就在酝酿把OpenAI学到的世界模型(world model)技术,真正落地到最需要它的地方:制造业。

现在他带着三位联合创始人杀回来:Augustus Odena(前Adept AI联合创始人,扩散模型和生成AI大牛)、Jakob Frick和Alex Mark(两位Palantir老将)。团队配置一眼就能看出野心——既有生成式AI的顶尖理解力,又有把AI塞进企业级系统的实战经验。

Arda的核心技术:用真实工厂视频端到端训练机器人

Arda的核心技术,说白了就一句话:用真实工厂视频,端到端训练机器人自治策略。

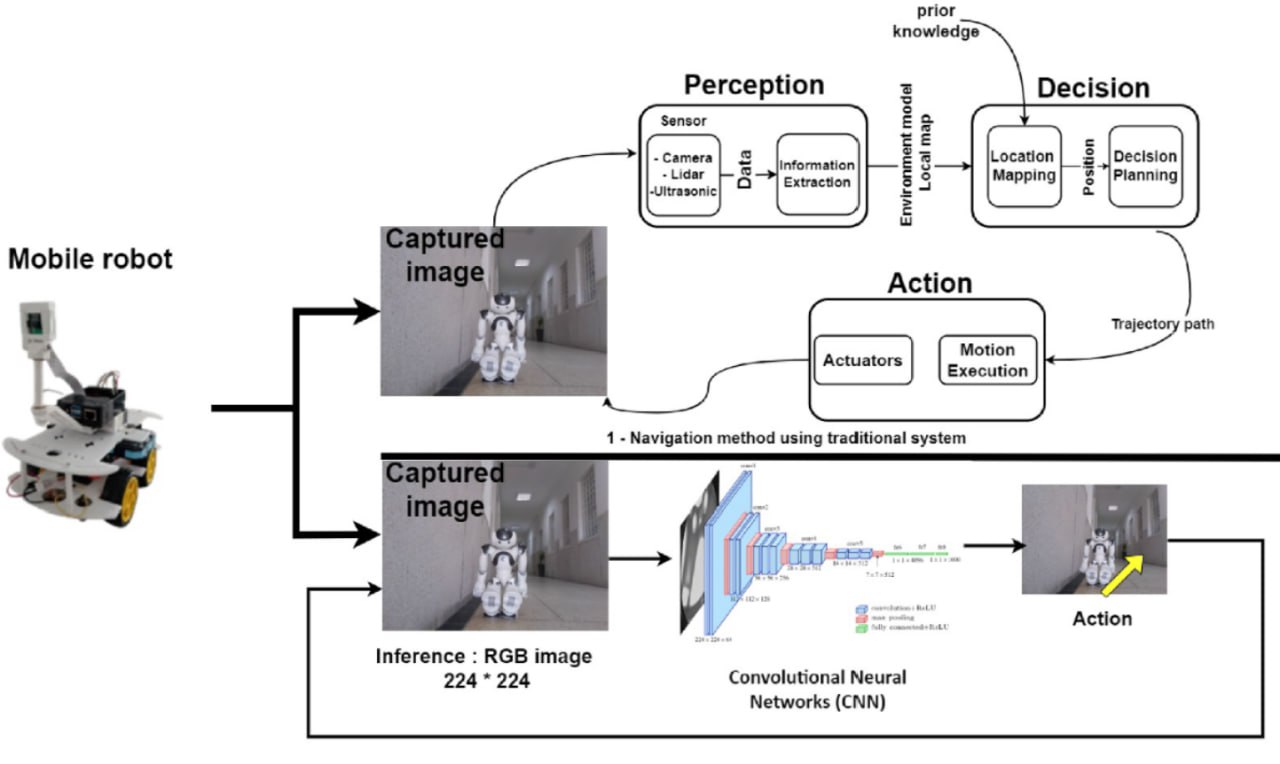

先理解传统机器人为什么卡住。过去二十年,工业机器人主要靠两种路子:一是编程式(工业6轴机械臂,写死动作序列);二是强化学习+仿真(在虚拟环境里摔几百万次,学走路)。前者灵活性差,换个产品线就要重写代码;后者"模拟到现实差距"(sim-to-real gap)巨大——仿真里光滑的地板,现实里可能有油污、电缆、工人突然走过。结果就是:机器人只能在高度结构化的产线干简单重复活,复杂场景一塌糊涂。

Arda的突破点在于:直接吃真实视频。

工厂里本来就布满监控摄像头,每天产生海量4K/8K视频——工人怎么抓取零件、怎么避开障碍、怎么和同事默契配合、机器怎么因为温度变化微微变形……这些都是最宝贵、也最"脏"的训练数据。Arda的视频模型(video model)本质上是一个大规模世界模型:输入一段视频序列,模型预测"下一个状态"是什么,以及机器人该采取什么动作。

技术路径:从感知到行动的完整闭环

技术路径大概是这样的:

1. 感知层

用Vision Transformer或类似架构,把视频帧序列编码成高维表征,同时融合多模态数据(可能还有力反馈、温度传感器、PLC信号)。

2. 世界模型核心

借鉴OpenAI Sora、NVIDIA Cosmos、Google Genie等最新视频生成/预测技术,构建一个能"想象"工厂下一帧的动态模型。它不只是预测像素,而是预测物理状态——零件位置、机器人关节扭矩、潜在碰撞风险。

3. 决策与行动

端到端神经策略(end-to-end policy)。传统是"感知→规划→控制"三段式,Arda要让一个大模型直接输出电机指令。类似Figure 02或Tesla Optimus的做法,但训练数据不是实验室演示,而是真实产线百万小时视频。

4. 持续学习闭环

机器人上线后,每一次操作都会回传新视频,模型在线微调,形成"看→做→改进"的飞轮。

这套东西一旦跑通,任何工厂老板都能干一件事:把过去十年的监控录像喂给Arda,十分钟后得到一个能复制"老工人手法"的机器人策略。McGrew在早期描述里强调:这不是"让机器人模仿人",而是"让AI理解整个生产流程的因果关系"。从产品设计可制造性,到供应链波动,再到成品下线,全链路协调。

为什么这是"下一代工业大模型"?

为什么说这是"下一代工业大模型"?因为它把大模型的规模化优势第一次真正带到了物理世界。

大语言模型的成功,靠的是"缩放定律"——更多参数+更多数据=更好性能。机器人领域一直缺的就是"数据"。仿真数据再多,也解决不了现实的分布偏移。现在Arda把工厂现成的视频变成可无限扩充的"教科书",相当于给机器人行业按下了ChatGPT时刻的开关。想象一下:一家汽车厂把十年焊接视频喂进去,模型不仅学会当前工艺,还能预测新材料下的变形、优化焊枪角度、甚至建议工艺改进。精度冲到99.8%,能耗降40%,这在亚洲几条试点线已经隐隐看到影子——小米、某些新能源车企的"黑灯工厂"里,机器人已经能3小时完全自主操作,自攻螺丝成功率90%以上。

Arda的雄心不止于单个机器人,而是整个工厂的"数字孪生+自治协调"。他们的平台还要做机器与机器、机器与人、机器与ERP系统的统一调度。举个例子:上游零件延误,模型能实时重新规划产线节拍;工人临时调整工序,机器人立刻跟上节奏;甚至产品设计变更,AI能提前评估对下游制造的影响。这才是真正的"端到端"——从比特到原子的一体化。

挑战与机遇:技术、安全与地缘博弈

当然,挑战也不小。视频模型算力需求极高,工厂边缘部署需要高效的SLM(小语言模型)或专用NPU;安全性和可解释性是监管红线(机器人突然"脑补"错动作怎么办);数据隐私——工厂视频里可能有知识产权。McGrew的Palantir背景在这儿就显优势了:他当年就是做数据治理和隐私计算的。

更深层的意义,是地缘与产业的双重博弈。

过去几十年,制造业向中国转移,靠的是人力成本+供应链集群。现在劳动力短缺、供应链安全焦虑(地缘政治因素),西方急需"去人力化"。Arda的目标很明确:让西方制造重新具备成本竞争力。报道里提到,他们想帮欧美工厂把中国式效率搬回家,却不用中国式人力规模。假如成功,可能是制造业"再本土化"的技术底座。

亚洲这边,其实已经走在前头。中国工厂的"黑灯模式"早已不新鲜,越南、印度的一些电子组装线也在加速。Arda的视频路径,正好能让这些高密度摄像头数据变成全球可共享的财富——前提是数据主权处理得当。未来或许会出现"视频数据市场":工厂匿名上传工艺视频,换取经过微调的机器人模型。

对"工作"的重新定义

我个人最兴奋的观察,是它对"工作"的重新定义。

当机器人能从视频里学会99%的重复劳动,人类终于可以彻底从"操作工"角色里解放。工厂里剩下的,将是"机器人训导师"(教AI新技能)、“系统优化师”(调整个流程)、“创意工程师”(设计新产品)。白领办公室曾经是工业革命后的新贵,现在AI先吃掉屏幕里的脑力劳动,再通过Arda吃掉物理世界的重复劳动。下一个十年,真正的稀缺资源会是"人类独有的判断力、创造力、同理心"。

当然,阵痛在所难免。短期内,低技能岗位会消失,需要大规模再培训;社会要讨论机器人税、基本收入、终身学习体系。这些话题已经不是科幻,而是各国智库和两会的必谈议题。

结语:物理AI的真正价值

Arda才刚起步,产品还没落地,估值7亿也带着泡沫的味道。但McGrew的履历摆在那儿:他参与过PayPal的反欺诈、Palantir的大数据治理、OpenAI的AGI冲刺。现在他把目光投向最脏最累的工厂,恰恰说明——AI真正的价值,从来不在云端,而在把物理世界变得更可预测、更高效、更人性化。

当第一家完全由Arda驱动的"无人灯厂"24小时灯火通明,却没有一个工人拧螺丝时,我们会突然意识到:工业革命把人从田野赶进工厂,信息革命把人赶进办公室,而这一波物理AI革命,或许终于把人解放出来,去做真正值得做的事。

那一天,不会太远。Arda的视频模型,正在一点点把工厂的每帧画面,变成未来世界的蓝图。