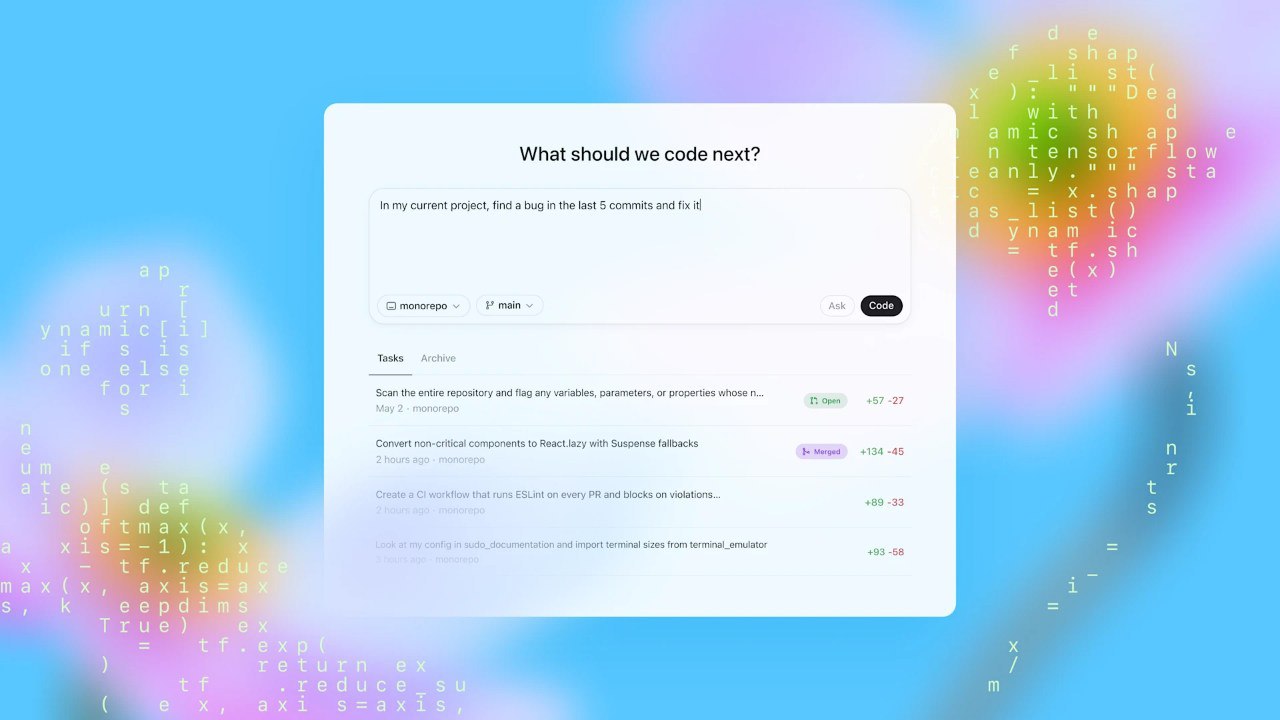

在人工智能迅猛发展的2026年,软件工程领域正迎来一场革命性的转变。OpenAI,作为AI领域的领军者,近日公布的一项内部实验–“Harness Engineering”,以"Agent-First"(智能体优先)的理念,彻底颠覆了传统的软件开发模式。这一实践并非简单的AI辅助编码,而是将人类工程师从代码编写者转变为系统设计师和监督者,让AI智能体(Agent)承担实际执行任务。实验结果令人震惊:一个三人团队在五个月内,从空仓库起步,构建出一个内部产品,全程零行人工手写代码,却生成约100万行代码、合并1500个PR(Pull Request),人均日吞吐3.5个PR,效率约为传统手写模式的10倍。这一成就不仅验证了AI在软件工程中的潜力,还为整个行业提供了宝贵的洞见。本文将深度剖析这一实践的核心要素、挑战与启示,探讨其对未来软件开发的深远影响。

实验背景:从禁令到突破

OpenAI的"Harness Engineering"实验源于一个大胆的假设:如果禁止人类工程师手动编写代码,软件开发还能进行吗?这一实验由OpenAI的Codex团队主导,Codex是基于GPT系列模型的AI编码工具,已从简单的代码补全演变为能够处理复杂任务的智能体系统。

实验从2025年底启动,持续五个月,目标是构建一个内部产品,用于数百名OpenAI员工的日常使用。核心约束是"零手动代码":所有代码、测试、CI(持续集成)配置、文档、可观测性和工具均由Codex Agent生成。

为什么选择这样的极端方式?OpenAI团队认为,AI模型的快速进步(如GPT-5的集成)已使传统编码变得低效。

在实验中,人类工程师的角色被重新定义为"掌舵者":他们负责分解目标、指定意图、构建反馈循环,而Agent则执行具体工作。这种"人类掌舵,Agent执行"的哲学,确保了AI的可靠性和效率。结果显示,Agent不仅能生成代码,还能处理调试、审查和迭代,整个过程模拟了一个自主的"AI工程团队"。

具体数据令人印象深刻:从空Git仓库开始,Codex生成了约100万行代码,涉及应用本体、测试套件和基础设施。1500个PR的合并,平均每个PR处理时间大幅缩短,人均日吞吐达3.5个,整体效率提升10倍。

这并非夸大其词–OpenAI强调,这种速度得益于Agent的并行处理能力,例如在工程师休息时,Agent可连续运行6小时以上,处理日志查询和Bug修复。

这一实验并非孤立事件。早在2024年,OpenAI就推出了Codex的早期版本,用于代码生成。

但"Harness Engineering"将其推向极致,将Agent置于开发的核心,人类仅提供高层指导。这反映了AI从工具向伙伴的演变,也预示了软件工程的"Agentic"未来。

工程师角色的革命性转变

传统软件工程中,工程师是代码的直接创造者。但在Agent-First模式下,这一角色发生了根本变化。OpenAI团队发现,早期进展缓慢,不是因为Agent能力不足,而是环境规范性欠缺–Agent需要清晰的工具、抽象和结构来可靠工作。

工程师的工作从"写代码"转向"启用Agent写代码":他们深度优先分解目标(如设计、编码、审查、测试),提示Agent构建模块,并建立反馈回路。当问题出现时,不是简单重试,而是分析"Agent缺少什么能力?如何使其可见且可强制执行?“这是一种元级转变–工程师成为环境设计师,专注于创建让Agent高效运转的"Harness”(线束或框架)。

例如,在处理Bug时,人类指定意图,Agent则通过集成Chrome DevTools Protocol自行截图、操控DOM、复现问题。

这种分工让人类专注于高价值任务,如战略决策和质量把关,而Agent处理重复性劳动。结果是,生产力指数级提升,但也要求工程师掌握新技能:提示工程、系统设计和AI行为建模。

这一转变并非一帆风顺。OpenAI承认,初期瓶颈在于人类适应新角色–从生产者到监督者需要心态调整。

但一旦适应,收益巨大:实验产品已有数百用户,证明了模式的实用性。

知识管理的创新:从大文件到结构化生态

知识管理是"Harness Engineering"中最具启发性的部分。团队最初尝试将所有指导放入一个大文件"AGENTS.md",但很快失败:文件过大难以验证、易过时、指导过多等于无指导,还占用宝贵上下文窗口。

解决方案是转向结构化文档系统:将"AGENTS.md"控制在约100行,仅作为目录和导航。核心知识存储在docs/目录中,包括设计文档、执行计划、产品规格、架构描述和质量评分,所有文件版本化、可索引。设计原则是"渐进式披露":Agent从稳定入口起步,按需导航深层内容,避免信息 overload。

为维护文档健康,引入自动化lint和CI检查,还有一个"文档园丁"Agent–定期扫描过时内容、提交修复PR。

这将知识从静态"百科全书"转变为动态"地图",确保Agent随时访问最新信息。

从Agent视角看,任何运行时不可访问的信息等同不存在。Slack对话、Google Doc或人脑共识对Agent无效,因此团队持续将上下文推入仓库。

技术选型偏好"无聊技术"–API稳定、在训练数据中充分表征的工具。某些情况下,Agent自行实现子功能比依赖第三方库更可靠。

这一知识管理模式强调"仓库即真理源头",为AI驱动开发提供了范式。

它不仅提升了效率,还降低了新成员(人类或AI)的上手成本。

Agent可读性与架构约束:速度的基石

在Agent-First世界,代码的可读性不止于人类–Agent必须能理解和扩展它。OpenAI强调,从Agent视角优化仓库:偏好可内部化、在仓库中可推理的依赖和抽象。

架构设计是关键:每个业务领域分为固定层次(Types → Config → Repo → Service → Runtime → UI),依赖单向,跨切关注点通过Providers接口注入。自定义lint拦截违规,错误消息嵌入修复指引,让Agent自行纠正。

这种通常在大团队才用的纪律,在Agent模式下是早期前提–约束即速度。

约束不是全面的:集中管控边界,局部自治。Agent生成的代码可能不符人类风格,但只要正确、可维护、对未来Agent可读,即合格。这挑战了传统美学,优先实用性。

为增强Agent能力,暴露UI、日志和指标:集成本地可观测性栈,Agent用LogQL和PromQL查询。

单次运行超6小时,往往在夜间完成复杂任务。

挑战治理:熵与自治的平衡

Agent会复制仓库模式,包括不良模式,导致"AI slop"(AI垃圾)。早期,团队每周花20%时间手动清理,无法持续。

解决方案是编码"黄金原则",建立自动化循环:后台Codex任务扫描偏差、更新质量评分、提交重构PR,大多在一分钟内审查合并。技术债如高息贷款,持续小额偿还优于积累后清偿。

自治里程碑是亮点:单一提示下,Codex端到端完成Bug复现、修复、验证、PR创建,仅在需人类判断时升级。

但OpenAI审慎:这依赖特定仓库结构,不易泛化。

挑战还包括伦理问题:AI监控与隐私、失业风险。但OpenAI视之为机会,推动人类向更高层工作迁移。

行业影响:软件开发的范式转移

"Harness Engineering"对行业的启示深刻。首先,它证明Agent-First可行,效率提升10倍将重塑开发流程。

企业可借鉴:投资Harness基础设施,训练员工提示工程。

其次,知识管理创新适用于任何AI集成项目。结构化文档+自动化园丁,可减少信息孤岛,提升协作。

再次,架构约束提醒:AI时代,严谨设计是前提。偏好"无聊技术"可能影响开源生态,推动更可靠的工具开发。

最后,这一实践加速AI自主化。OpenAI的Codex已从CLI扩展到IDE和云工作流,未来或整合多模态能力。

但需警惕风险:如Gartner预测,到2028年,AI误配置可能导致基础设施停摆。

未来展望:机遇与隐忧

展望未来,Agent-First将从实验走向主流。OpenAI的"Harness"可能演变为标准框架,支持多Agent协作。

结合Strawberry等先进推理技术,AI可处理更复杂任务。

机遇包括:民主化开发,让非程序员参与;加速创新,缩短产品周期。但隐忧存在:AI黑箱性、偏见放大、就业冲击。需建立伦理框架,确保人类监督。

此外,计算资源将是瓶颈:长运行任务需高效算法。OpenAI的实践提示,未来软件工程将是人机共生,人类智慧指导AI执行。

结语:拥抱Agent-First的曙光

OpenAI的"Harness Engineering"不仅是技术实验,更是哲学转变。它证明,在Agent-First时代,人类的时间和注意力是最稀缺资源。通过掌舵而非执行,我们可解锁AI无限潜力。这一实践为软件工程指明方向:从代码中心转向意图中心,从个体劳动转向生态构建。未来已来,让我们共同塑造一个更智能、更高效的开发世界。