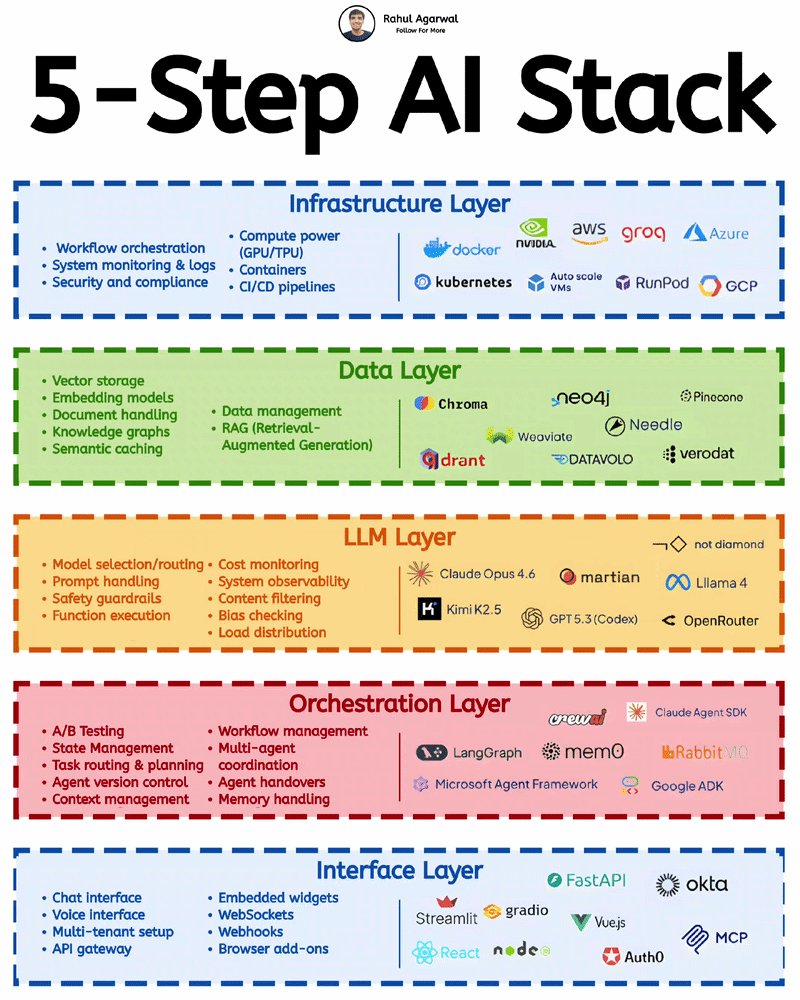

摘要:“每个人都在部署AI。很少有人部署对了。” —— 一位为50多家企业设计过AI架构的瑞士架构师 2026年,AI应用的门槛已经低到令人发指。一个周末,一个人,几行Prompt,就能搭出一个看起来很像样的AI产品。 但"看起来像样"和"真正能用"之间,隔着一道深渊。 这道深渊的名字叫:架构。 最近,一张在推特上疯传的AI系统架构图引发了广泛讨论。它把一个生产级AI系统拆成了五层:数据层、模型层、编排层、接口层、基础设施层。看起来简单,但每一层背后都藏着无数团队踩过的坑。 今天我们就来逐层拆解:一个真正能扛住生产环境的AI系统,到底长什么样?

“每个人都在部署AI。很少有人部署对了。”

—— 一位为50多家企业设计过AI架构的瑞士架构师

2026年,AI应用的门槛已经低到令人发指。一个周末,一个人,几行Prompt,就能搭出一个看起来很像样的AI产品。

但"看起来像样"和"真正能用"之间,隔着一道深渊。

这道深渊的名字叫:架构。

最近,一张在推特上疯传的AI系统架构图引发了广泛讨论。它把一个生产级AI系统拆成了五层:数据层、模型层、编排层、接口层、基础设施层。看起来简单,但每一层背后都藏着无数团队踩过的坑。

今天我们就来逐层拆解:一个真正能扛住生产环境的AI系统,到底长什么样?

第一层:数据层——AI的"记忆"和"知识库"

如果把AI系统比作一个人,数据层就是它的记忆和知识储备。没有这一层,再聪明的大模型也只是一个"有文化但没见过世面"的书呆子。

这一层要解决的核心问题是:怎么让AI获取、理解和检索它需要的信息?

几个关键组件:

- 向量数据库(Pinecone、Qdrant、Chroma):把文本转成数学向量存起来,让AI能做语义搜索——不是关键词匹配,而是"理解意思"的搜索

- Embedding模型:负责把人类语言翻译成机器能理解的向量表示

- 文档处理:把PDF、Word、网页等各种格式的文档解析成结构化数据

- 知识图谱(Neo4j):把实体和关系连接起来,让AI不只是"知道",还能"推理"

- RAG系统:检索增强生成,让大模型在回答问题时能查阅外部知识,而不是只靠自己的"记忆"

- 语义缓存:把常见问题的回答缓存起来,下次遇到类似问题直接复用,又快又省钱

这里最容易踩的坑是什么?RAG实现得不好,比没有RAG更糟糕。

一位资深AI架构师的经验是:chunk size(文档切块大小)、embedding模型选择、检索策略(稠密检索 vs 稀疏检索 vs 混合检索)、重排序——这些实现细节决定了RAG是"给AI加了外挂"还是"给AI喂了垃圾"。一个检索到不相关上下文的RAG管道,产出的结果比完全不用RAG还差。

第二层:模型层——AI的"大脑"

这是大多数人最熟悉的一层:大语言模型本身。GPT、Claude、Gemini、Llama……选哪个?怎么用?

但生产环境中的模型层远不只是"调一个API"这么简单:

- 模型选择/路由:不同任务用不同模型。简单的分类任务用便宜的小模型,复杂推理用大模型。这一招能把成本砍掉60%-80%,质量损失微乎其微

- Prompt工程:结构化和优化输入,让模型的输出更稳定、更可控

- 安全护栏:防止模型产出有害、不安全或不合规的内容

- 函数调用:让模型能调用外部工具和API,从"只会说话"变成"能干活"

- 成本监控:追踪每次调用的token消耗和费用,防止账单爆炸

- 可观测性:监控模型的性能和行为,出了问题能快速定位

- 负载均衡:在多个模型之间分配流量,避免单点故障

这里2026年最大的趋势是:小模型正在赢。

GPT-4级别的模型用来处理所有任务,既贵又慢。越来越多的团队采用"路由"策略:用一个轻量级模型做分类和简单任务,只在需要复杂推理时才调用大模型。这不是降级,这是工程智慧。

还有一个致命错误:单一模型依赖。 如果你的整个系统只依赖一个模型供应商,那你离全面瘫痪只差一次API变更或一次宕机。从第一天起就设计模型无关的抽象层,让你能随时切换供应商。

第三层:编排层——AI的"神经系统"

如果说模型层是大脑,编排层就是神经系统——它决定了信息怎么流动、任务怎么分配、多个Agent怎么协作。

这是大多数AI项目失败的地方。

编排层要处理的事情包括:

- 状态管理:追踪会话和工作流的状态,知道"我们聊到哪了"

- 任务路由与规划:决定下一步该做什么,该交给哪个Agent

- 上下文管理:维护相关的对话上下文,不让AI"失忆"

- 工作流管理:定义多步骤的执行流程

- 多Agent协调:让多个Agent协同工作,而不是互相打架

- Agent交接:在Agent之间转移任务,像接力赛一样

- 记忆处理:存储和检索过去的交互,让AI有"长期记忆"

这里有一个核心设计原则:Agent应该窄而可组合,而不是宽而单体。

一个"既能研究、又能写作、又能排版、又能发邮件"的全能Agent,是调试的噩梦。正确的做法是拆分职责:研究Agent只管研究,写作Agent只管写作,然后用编排层把它们串起来。

另一个被严重低估的问题是延迟预算。一次LLM调用需要1-5秒。一个包含5次串行调用的多Agent管道需要5-25秒。而用户在3秒后就会失去耐心。从第一天起就要设计并行化:哪些调用可以同时进行?

常用工具:LangGraph、CrewAI、Mem0,以及越来越多团队选择自己写轻量级编排框架——因为LangChain这类重框架在原型阶段很好用,到了生产环境往往太重、太不透明。

第四层:接口层——AI的"脸"

这是用户真正接触到的一层。再强大的AI系统,如果接口层做得烂,用户体验就是零。

接口层的组件:

- 聊天界面:最常见的交互方式,文本对话

- 语音界面:2026年的新标配。实时语音AI(延迟低于200毫秒)已经可以实现,正在成为客户端AI系统的标准层

- 多租户架构:支持多用户/多账户,企业级必备

- API网关:管理和路由API请求,做限流和鉴权

- 嵌入式组件:把AI能力嵌入到其他应用中

- WebSocket:实时双向通信,让对话流畅自然

- Webhook:通过事件触发动作,实现自动化

- 浏览器插件:把AI能力延伸到浏览器中

这里2026年最大的变化是:语音正在成为一等公民。

过去语音只是"锦上添花",现在它正在成为很多场景的主要交互方式。实时语音AI管道(语音转文字 → LLM处理 → 文字转语音)的延迟已经压到200毫秒以内,用户体验接近真人对话。

另一个趋势是MCP(Model Context Protocol)的崛起——它正在成为AI系统与外部工具和数据源交互的标准协议,就像HTTP之于Web一样。

第五层:基础设施层——AI的"地基"

最后一层,也是最容易被忽视的一层。大多数团队在这里投入不足,直到一次生产事故逼他们正视现实。

基础设施层包括:

- 算力(GPU/TPU):高性能模型推理的硬件基础

- 容器与编排(Docker、Kubernetes):大规模管理应用部署

- 监控、日志、安全:追踪系统健康状态,保障安全

- CI/CD流水线:自动化构建和部署

2026年这一层最值得关注的变化是:边缘推理变得真实了。

在笔记本电脑甚至手机上运行70亿参数的模型,现在已经完全可行。这改变了隐私计算的格局:敏感数据可以留在本地,不需要上传到云端。对于医疗、金融、政务等对数据安全要求极高的场景,这是一个游戏规则改变者。

另一个关键点:可观测性不是可选项,是必选项。 LangSmith、Helicone 或自建的监控系统——你必须能看到每一次LLM调用的输入、输出、延迟、成本和错误。没有可观测性的AI系统就像没有仪表盘的飞机,迟早要坠毁。

五层之间的关系:不是堆叠,是咬合

很多人看到"五层架构"会以为这是一个简单的从下到上的堆叠。不是的。

这五层之间是深度咬合的关系:

- 数据层的RAG质量直接影响模型层的输出质量

- 模型层的延迟决定了编排层能设计多复杂的工作流

- 编排层的状态管理影响接口层的用户体验

- 基础设施层的算力和成本约束反过来限制了上面所有层的设计空间

任何一层的短板,都会成为整个系统的瓶颈。

这就是为什么那么多AI产品"Demo很惊艳,上线就崩"——它们可能在模型层做得很好(选了最强的模型),但在数据层(RAG实现粗糙)、编排层(没有错误处理)、基础设施层(没有监控)上全是漏洞。

给技术决策者的三条建议

1. 先建评估管道,再建产品。 你无法改进你无法衡量的东西。在部署任何AI系统之前,先定义评估指标,搭建测试框架。用LLM来评判LLM的输出(LLM-as-judge)效果出奇地好,前提是你把评估Prompt设计好。

2. 从第一天起就设计模型无关性。 把LLM调用抽象到一个可以随时切换供应商的接口后面。今天最好的模型,明天可能不是。

3. 在编排层投入最多的设计精力。 模型会越来越强,基础设施会越来越便宜,但编排层的设计决策——任务怎么拆分、Agent怎么协作、错误怎么处理——这些是真正决定系统成败的地方。

写在最后

2026年的AI不再是"调一个API"的事。它是一个完整的系统工程问题,需要数据工程、模型工程、分布式系统、前端交互、基础设施运维等多个领域的能力协同。

好消息是:当你理解了这五层架构,你就有了一张清晰的地图。你知道自己在哪一层强、哪一层弱,该在哪里投入、该在哪里借力。

坏消息是:大多数团队还在第二层(模型层)上死磕,以为换一个更强的模型就能解决所有问题。

模型是大脑,但没有神经系统、没有记忆、没有感官、没有骨骼的大脑,什么也做不了。

五层都建好,你的AI系统才真正活过来。

参考来源:

- Vaidehi, “Every AI system must have these 5 layers”, X/Twitter, 2026年4月19日

- DEV Community, “AI Architecture in 2026: The Stack That Actually Works”

- Gleecus, “What Is an AI Stack? A Complete Guide to LLMs, RAG, AI Hardware & More”, 2026年4月

- Glean, “The emerging agent architecture”, 2026年2月