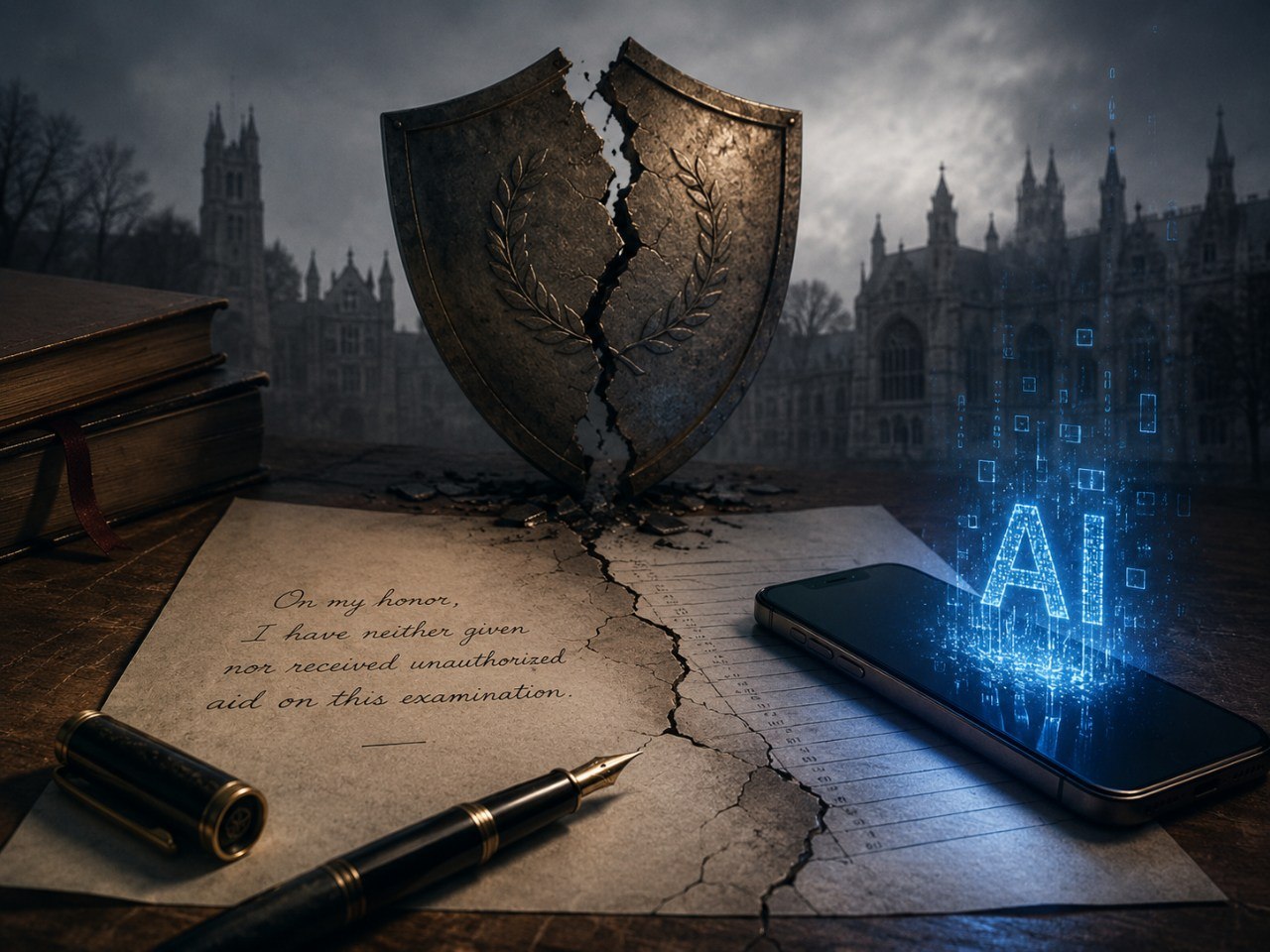

摘要:普林斯顿决定自 2026 年 7 月 1 日起恢复所有线下考试教师监考。这不是一条普通校园新闻,而是 AI 正在迫使一套运行了 130 多年的教育信任制度,从道德宣言走向可执行机制。

普林斯顿这次改制度,看上去只是一个校园新闻:从 2026 年 7 月 1 日起,所有线下考试都将恢复教师监考。这是普林斯顿自 1893 年建立荣誉制度以来最重大的变化之一,教师投票几乎一边倒通过,只有一票反对。

但真正值得观察的,不是“名校学生也作弊”,而是 AI 把一套运行了一百多年的教育信任系统,推到了必须重写规则的边缘。

一套靠共同体维持的古典契约,被 AI 撬开了

普林斯顿的荣誉制度,本来是一种非常古典、也非常精英主义的教育契约:考试没有教授监考,学生在试卷上承诺自己没有违反荣誉准则,同时也有义务举报看到的违规行为。

普林斯顿官方材料强调,这套制度从 1893 年延续至今,核心是学生个人诚信与同侪责任的结合。也就是说,它不只是“不监考”,而是把考试秩序建立在学生共同维护共同体声誉之上。

但 AI 到来后,这个契约的几个前提同时坍塌了。

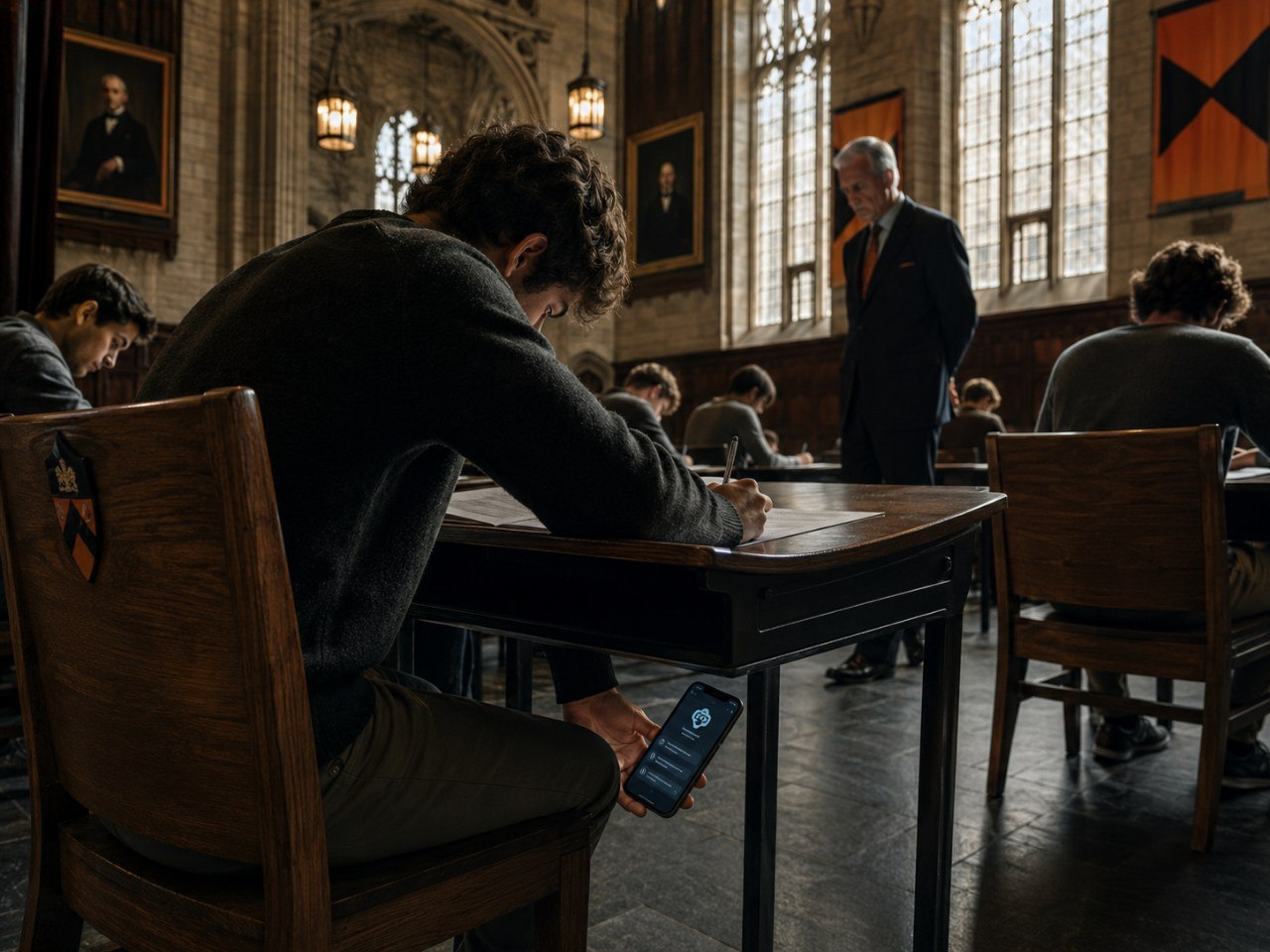

过去作弊往往是纸条、偷看、夹带资料,行为本身有外在痕迹,同学看得到,也容易判断。现在,一个学生低头看手机,可能是在查时间,也可能是在让 ChatGPT、Gemini 或其他工具直接生成答案。

普林斯顿政策提案明确提到,生成式 AI 降低了在考试中获得不公平优势的门槛,而小型个人设备又改变了作弊的外观,让其他学生更难观察和举报。

不是技术失效,而是“举报”这件事先失效了

更关键的是,同侪举报这件事在今天的学生文化里变得越来越难。

普林斯顿材料中提到,很多举报已经变成匿名举报,部分原因是学生担心在社交媒体环境中被曝光、羞辱甚至“人肉”。这说明问题已经不只是技术问题,而是社会关系问题。

荣誉制度依赖学生彼此监督,但今天的学生生活在一个高度可见、可传播、可反噬的网络环境里。举报不再只是维护规则,也可能被理解为“背刺同学”。

最刺眼的数据来自《Daily Princetonian》的 2025 届毕业生调查:约 30% 的受访学生承认在普林斯顿期间至少有过一次作弊;27.7% 承认曾在不被允许的情况下使用 ChatGPT 完成作业;另有 44.6% 的受访者表示见过荣誉准则违规却没有举报,真正举报过同学的比例只有 0.4%。

这组数字的意义,不在于“普林斯顿道德堕落”,而在于 当违规成为可见的群体现象、举报却成为极少数行为时,制度本身已经失去了执行基础。

恢复监考,不是回到旧时代,而是补上一层证据机制

所以,这次恢复监考并不是简单地回到旧时代。

普林斯顿的制度设计其实很克制:教师进入考场,但并不直接干预学生,而是作为“额外见证人”存在;如果发生疑似违规,教师记录观察并向学生主导的荣誉委员会报告。

换句话说,学校并没有废除荣誉制度,而是给它加上了一层现实世界的证据机制。政策文件也承认,监考无法根除作弊,但可以形成威慑,并减轻学生在考试中一边答题、一边监督同伴的压力。

这正是 AI 对教育的深层冲击:它不是让学生第一次拥有作弊工具,而是让作弊从“冒险行为”变成“低摩擦流程”。

过去作弊需要准备、胆量和现场操作风险;现在学生只要把问题输入工具,就能获得看似完整、流畅、结构化的答案。对于高压环境中的学生来说,这种诱惑极其强烈。

AI 最危险的地方,不是它会写错,而是它太会“完成任务”

Ars Technica 文章里有一句特别值得玩味:很多学生并不真的认为自己用 AI 代写是在学习,他们只是把它当成“工作量管理”。

这句话很残酷,却很接近现实。

AI 在教育场景中最危险的地方,不是它会写错,而是它太擅长把学习伪装成完成任务。学生交了作业,老师批了文字,系统记录了成绩,但中间真正应该发生的认知摩擦、概念消化、表达训练、错误修正,可能根本没有发生。

这也解释了为什么“检测 AI”很难成为根本解法。越来越多高校发现,AI 检测工具不能作为学术不端的可靠证据。原因包括准确性不稳定、误报风险、对非英语母语写作者不公平,以及可能破坏师生信任。

因此,AI 检测结果最多只能是线索,而不是定罪证据;学校真正需要做的,是明确什么可以用、什么不能用,以及违规时如何基于过程证据来判断。

高校真正要重建的,不是纪律,而是“学习证据”

于是,高校面临一个尴尬现实:

- 不监考,信任系统失效;

- 全靠检测,技术和程序正义都站不住;

- 完全禁止 AI,又与真实世界脱节。

普林斯顿的选择,本质上是把考试中最核心的公平环节重新拉回可观察空间。它没有解决所有问题,但先解决了一个最基本的问题:在需要独立完成的场景里,学校必须有能力确认“这个过程大致是学生自己完成的”。

但如果只停留在恢复监考,教育仍然会输。因为 AI 对教育的挑战不是“学生能不能作弊”,而是 我们如何重新定义学习证据。

传统作业之所以脆弱,是因为它往往只看最终文本;可生成式 AI 最擅长的,恰恰就是制造最终文本。未来更可靠的评价方式,必须更多关注过程:

- 草稿如何演变;

- 学生如何解释自己的判断;

- 错误如何被修正;

- 课堂讨论中能否即时推理;

- 项目中能否把知识迁移到真实问题。

这意味着高校需要把评价体系拆成三层。

第一层:底线型考试

比如闭卷、开卷但受控、口试、现场推导,用来确认学生掌握了不可外包的基本能力。

第二层:过程型作业

比如多轮草稿、版本记录、课堂展示、同伴质询,用来观察思考是如何发生的。

第三层:AI 协作型任务

允许学生使用工具,但必须说明使用方式、判断依据和人工修正过程。这样,AI 不再是偷偷摸摸的替身,而变成被纳入规范的工具。

普林斯顿事件真正刺痛人的地方

真正的问题不是学生用了 AI,而是学生用 AI 以后,学校还按原来的方式给分。

一个学生让 AI 写论文,然后拿到高分,伤害的不只是公平,更是教育本身的信号系统。成绩本应代表能力,但如果成绩越来越代表“谁更会调用工具、谁更敢越界、谁更不怕被发现”,文凭的信用就会被慢慢稀释。

普林斯顿事件的象征意义也在这里。它告诉我们,即使是最精英、最强调荣誉传统的学校,也不能只靠文化解决技术带来的制度漏洞。信任不是口号,信任需要结构支撑。

过去,学生之间的共同体意识、荣誉誓言和低技术环境共同支撑了无监考制度;现在,智能手机、生成式 AI、社交媒体压力和高竞争环境共同削弱了它。

所以,这不是一个“AI 毁掉教育”的简单故事,而是一个更复杂的制度更新故事。

AI 暴露了教育里早已存在的裂缝:过度依赖结果文本,过度强调绩点竞争,过度相信学生会在高压环境中自发维护共同体规则。AI 只是让这些裂缝变得更大、更快、更难假装不存在。

最后:未来的好学校,不是禁 AI,而是会划边界

讽刺的是,相关报道页面上方甚至会出现 Gemini 广告。这个画面几乎构成了当代教育的隐喻:一边是大学在为 AI 作弊焦头烂额,另一边是 AI 公司在用“从练习到准备”这样的语言推销工具。

技术公司讲的是效率、赋能和未来,教师看到的却是学生把思考外包后的空洞文本。两种叙事之间,隔着一整个教育现场。

普林斯顿恢复监考,表面上像是退回传统,实际上是在承认一个新现实:在 AI 时代,教育不能再把“诚信”只当成学生的个人品德问题,而必须把它设计成制度、流程、评价和技术边界共同构成的系统。

未来的好学校,不是简单禁止 AI 的学校,也不是盲目拥抱 AI 的学校,而是能清楚区分三件事的学校:

- 什么时候必须独立思考;

- 什么时候可以借助工具;

- 什么时候必须证明自己真的理解了工具给出的答案。

这才是普林斯顿事件最值得深思的地方。

AI 没有让作弊诞生,但它让作弊变得便宜、隐蔽、规模化;AI 没有摧毁荣誉制度,但它迫使荣誉制度从道德宣言走向可执行机制;AI 也没有终结教育,但它正在逼迫教育重新回答一个最古老的问题:

我们到底是在训练学生完成任务,还是在训练学生成为能够独立判断的人?

参考来源

- Princeton University 关于 Honor System 调整与恢复教师监考的相关政策材料。

- The Daily Princetonian 关于 2025 届毕业生调查与荣誉制度争议的报道。

- Ars Technica 关于生成式 AI 对高校考试与作业制度冲击的报道。

- 高校教学支持机构关于 AI detection 工具局限性的公开建议与实践共识。