摘要:从核弹模拟催生的蒙特卡洛方法,到让CT扫描成为可能的Radon变换;从驱动ChatGPT的反向传播,到守护你每一次网购的RSA加密——50个算法构成了现代文明的隐形骨架。

你每天都在使用算法,但你可能从未意识到。

早上打开手机,指纹解锁背后是椭圆曲线密码学。查看天气预报,背后是集合卡尔曼滤波在超级计算机上同化全球气象卫星数据。刷短视频,推荐系统底层跑着随机梯度下降训练出的神经网络。开车导航,路径规划用的是Dijkstra算法的变体。甚至你拍的每一张照片能被压缩存储,都要感谢Lempel-Ziv无损压缩。

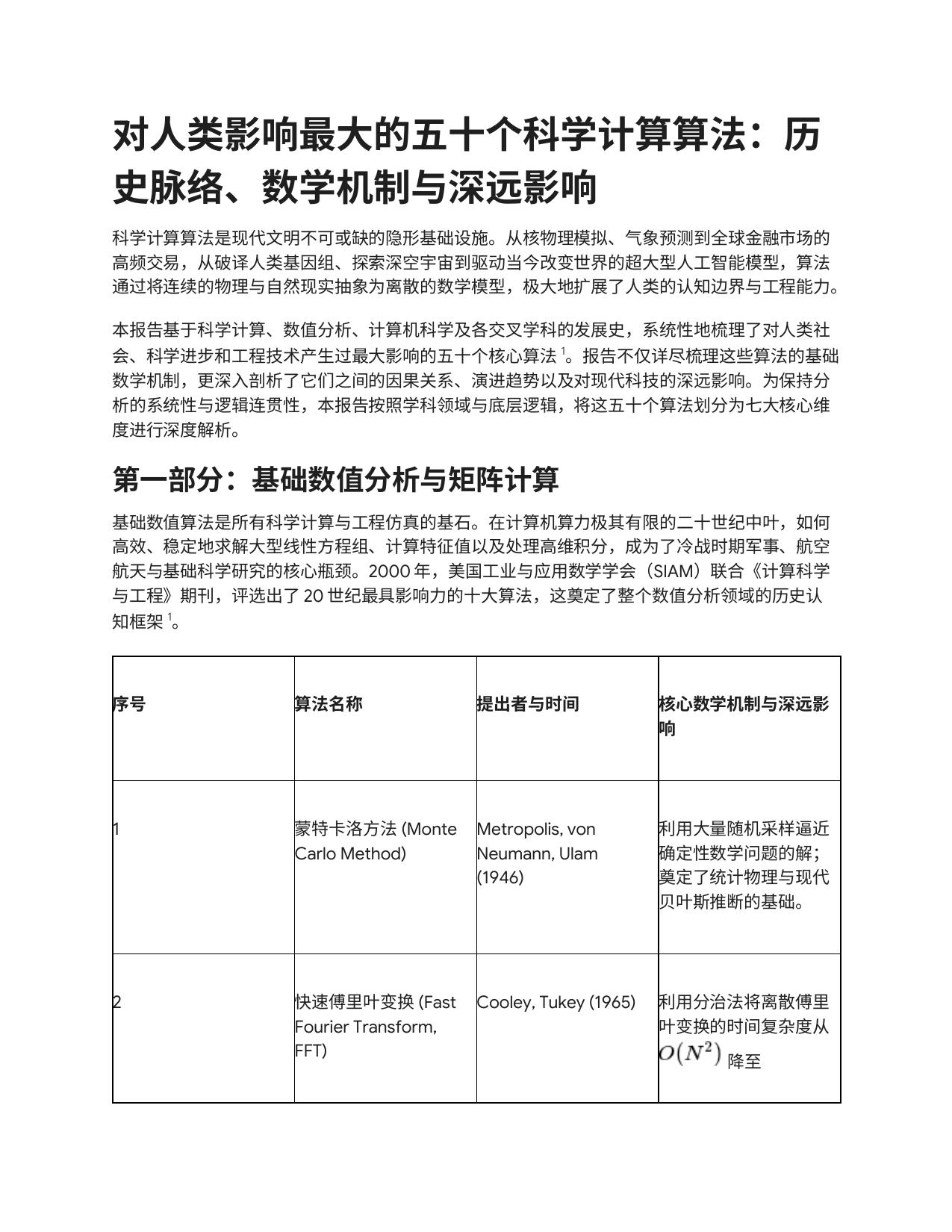

最近读到一份报告——《对人类影响最大的五十个科学计算算法》,它把从1946年到今天,真正改变了人类文明走向的50个核心算法做了一次系统梳理。读完之后最强烈的感受是:我们生活在一个由算法搭建的世界里,但绝大多数人对这个骨架一无所知。

这篇文章不打算罗列50个算法的定义。我想做的是,从中挑出几条最有故事感的线索,让你看到算法不是冰冷的数学公式,而是人类面对真实困境时迸发出的智慧火花。

核弹逼出来的随机性

1946年,洛斯阿拉莫斯国家实验室。曼哈顿计划的科学家们面临一个棘手问题:中子在裂变材料中的散射路径太复杂了,传统数学方程根本解不出来。

数学家乌拉姆(Ulam)和冯·诺依曼(von Neumann)想到了一个看似荒谬的办法:既然算不出精确答案,不如让计算机"掷骰子"——模拟大量粒子的随机游走,然后用统计规律逼近真实结果。

这就是蒙特卡洛方法的诞生。它的核心思想反直觉得令人不安:用随机性来解决确定性问题。

但它有效。而且有效得超乎想象。

80年后的今天,蒙特卡洛方法的后代无处不在:金融工程用它给衍生品定价,贝叶斯统计用它采样后验分布,粒子物理用它模拟对撞实验,甚至大语言模型生成文本时的"温度"参数,本质上也是在控制一种蒙特卡洛式的随机采样。

这个故事的启示是:有时候,放弃对精确的执念,反而能到达精确无法到达的地方。

冷战催生的速度革命

1965年,冷战正酣。美国需要实时监测苏联的地下核试验,方法是分析地震波信号。但问题是:把一段含有上百万数据点的信号分解成不同频率的成分(傅里叶变换),按当时的算法需要计算几十个小时。

库利(Cooley)和图基(Tukey)发现了一个巧妙的分治策略:把一个大问题不断对半拆分,利用对称性消除重复计算。时间复杂度从N²直接降到了N·log(N)。

对于100万个数据点,这意味着计算量从1万亿次降到了2000万次——提速5万倍。

这就是快速傅里叶变换(FFT)。它让实时信号处理成为可能,直接催生了数字音频、MRI核磁共振、雷达系统、Wi-Fi通信(OFDM调制)、甚至你手机里的语音识别。

有人说FFT是20世纪对人类生活影响最大的单个算法。这个说法可能并不夸张。

让AI从"寒冬"中苏醒的链式法则

1986年之前,神经网络是一个被学术界抛弃的方向。原因很简单:没有人知道怎么训练一个多层网络。你可以搭建一个有很多层的网络结构,但无法告诉每一层的参数应该怎么调整。

反向传播算法(Backpropagation)解决了这个问题。它的数学原理其实并不复杂——就是微积分里的链式法则,从输出层开始,把误差一层一层往回传,计算出每个参数对最终误差的贡献。

但这个"简单"的想法,加上随机梯度下降(SGD)的迭代优化,再加上后来GPU的并行计算能力,直接引爆了整个深度学习革命。

今天,无论是GPT-4、Claude、Gemini,还是AlphaGo、Stable Diffusion、自动驾驶系统,它们的参数更新核心仍然是反向传播+梯度下降。一个1986年的算法,至今仍在驱动2026年最前沿的AI系统。

更有趣的是,反向传播本身又建立在1964年Wengert提出的自动微分(AD)之上。AD不是数值微分(有截断误差),也不是符号微分(表达式会爆炸),而是在代码编译层面追踪每一步运算,精确应用链式法则。PyTorch和TensorFlow的核心引擎,本质上就是一个自动微分系统。

一个方程拿了诺贝尔奖

量子力学告诉我们,要精确描述一个分子的电子行为,需要求解薛定谔方程。但对于一个有N个电子的系统,波函数是3N维的——维度随电子数指数增长,这就是臭名昭著的"维数灾难"。

1965年,Kohn和Sham提出了一个天才的简化:不去计算那个恐怖的高维波函数,而是证明系统的所有性质都可以仅从三维空间中的电子密度推导出来。

这就是密度泛函理论(DFT)的核心——Kohn-Sham方程。它把一个指数级复杂的问题,变成了一个多项式级可解的问题。

这个算法让计算机模拟新材料、设计新药物、预测催化剂性能成为可能。Walter Kohn因此获得了1998年诺贝尔化学奖。今天,全球材料科学论文中有相当大比例的计算工作,底层都在跑DFT。

从CT扫描到你的每一次网购

1917年,数学家Radon证明了一个纯理论结果:一个物体的内部密度分布,可以通过它在所有方向上的投影来唯一确定。

这个结果在数学界沉睡了半个多世纪。直到1970年代,计算机足够快了,滤波反投影算法(FBP)被开发出来——CT扫描仪诞生了。从此,医生不用开刀就能看到人体内部的三维结构。

类似的故事发生在密码学领域。RSA加密(1977年)利用了一个简单的数学事实:把两个大素数相乘很容易,但把乘积分解回两个素数极其困难。这个"单向性"保护了你的每一次网上支付、每一封加密邮件、每一次HTTPS连接。

而现在,Shor算法(1994年)在理论上证明了量子计算机可以高效分解大数——这意味着一旦量子计算机成熟,现有的RSA加密体系将被彻底击穿。全球密码学界正在紧急研发"后量子密码",这场军备竞赛已经开始。

最朴素的算法统治了整个工业

最后说一个最"不性感"但可能影响最广的算法:PID控制。

它的数学公式简单到令人怀疑:看看当前偏差有多大(比例P),看看历史累积偏差有多少(积分I),看看偏差变化的趋势有多快(微分D),然后把三者加权求和作为控制输出。

就这么简单。

但这个算法统治了全球几乎所有的工业自动化系统。从阿波罗登月飞船的姿态控制,到芯片光刻机的纳米级工作台定位,从化工反应釜的温度控制,到你家空调的恒温系统——全是PID。

它不需要你对被控对象建立精确的数学模型。它只需要一个反馈信号,然后用最朴素的"看偏差、调输出"逻辑,就能让复杂系统保持稳定。

这可能是工程哲学最纯粹的体现:不追求完美理解,只追求有效控制。

算法的三个启示

读完这50个算法的演进史,有三个趋势特别值得注意:

第一,随机性正在成为确定性的盟友。 从蒙特卡洛到随机梯度下降,从模拟退火到集合卡尔曼滤波,越来越多的突破来自于"主动引入可控的随机性"。当确定性方法撞墙时,随机性往往能打开新的通道。

第二,算法和硬件是共生演化的。 FFT之所以伟大,不仅因为数学优雅,更因为它完美匹配了当时的计算架构。反向传播沉寂了20年,直到GPU出现才真正爆发。格子玻尔兹曼方法天然适合并行计算,所以在GPU时代焕发新生。算法不是孤立存在的,它需要硬件的"土壤"。

第三,最持久的算法往往最简单。 PID控制、梯度下降、FFT、蒙特卡洛——这些统治了几十年甚至近百年的算法,核心思想都可以用一句话说清。复杂的算法可能在特定场景下更优,但简单的算法有更强的生命力和更广的适用性。

这50个算法,就是现代文明的隐形骨架。它们不会出现在新闻头条里,但没有它们,就没有你今天习以为常的一切。

📥 附件下载: 对人类影响最大的五十个科学计算算法(完整报告PDF)