摘要:Timothy Gowers 对 ChatGPT 5.5 Pro 的测试,不再是“AI 会不会做题”,而是它能否在真实研究语境里,找到人类没有立刻采用的组合方式,并把它推进成可检验的证明。

2026 年 5 月,数学界和 AI 社区同时被一篇博客击中。作者不是普通测评人,而是 Timothy Gowers:菲尔兹奖得主、剑桥大学长期任教者,现任法兰西公学院组合数学讲席教授。法兰西公学院的传记显示,Gowers 1998 年获得菲尔兹奖,2009 年起担任英国皇家学会研究教授,2020 年被任命为法兰西公学院教授。也就是说,这不是一次“AI 震撼体”式的围观,而是一位一线数学家对前沿模型能力的严肃测试。

Gowers 的结论非常直接:我们不得不再次上调对大型语言模型数学能力的评估。他在博客开头说,ChatGPT 5.5 Pro 在约一小时内产出了一段“博士级研究”,而且几乎没有来自他的实质性数学输入。这个表述的重要性不在于“AI 又做对了一道难题”,而在于任务类型已经从竞赛题、课后题、已知定理复述,推进到真实研究文献中尚未完全处理的问题。

一、这次测试为什么不一样?

这次测试的背景,是 Melvyn Nathanson 一篇关于加性数论问题多样性的论文。Nathanson 讨论了有限整数集的和集大小、受限和集、和集交叠等问题,并强调某些看起来“边缘”的问题,日后也可能成为重要方向。论文中有一类问题可以粗略理解为:给定一个整数集合 A,我们关心 A+A 或 hA 能出现哪些大小,以及为了实现某个大小,集合元素需要分布在多大的区间里。Nathanson 原文也把“有限整数集和集大小”列为重点问题之一,并提出是否存在次指数或多项式界的问题。

Gowers 先让 ChatGPT 5.5 Pro 处理 h=2 的情形。模型思考 17 分 5 秒后,给出一个构造,把 Nathanson 原先的指数型区间界改进为二次上界;随后又用 2 分 23 秒把证明改写成数学预印本风格的 LaTeX。Gowers 花时间检查后认为论证正确。关键思想并不是凭空“发明数学”,而是把问题重述为 Sidon 集与等差数列的组合,再用更高效的 Sidon 集替代 Nathanson 构造中隐含的 2 的幂结构。

这点尤其值得注意。很多人会把 AI 的数学能力贬低为“只是拼接已有知识”。但数学研究中,大量有价值工作本来就来自重新表述、识别结构、替换更合适的工具、把已知技术放到新位置。Gowers 在文中也提醒:相当多优秀的人类数学,其实也是把已有知识和证明技术组合起来。真正的问题不是“它有没有从无到有地产生灵感”,而是:它能否在真实研究语境里,找到人类没有立刻采用的组合方式,并把它推进成可检验的证明。

二、真正震动数学界的,是哪一步?

更强的信号来自后续。Gowers 又让模型尝试一般 h 的情形。起初他并不乐观,因为 h=2 的情况有 Erdős–Szemerédi 的完整刻画,而一般 h 的可实现和集大小集合并没有那么简单。但 ChatGPT 5.5 Pro 先给出一个从指数界到更弱指数界的改进,再进一步尝试多项式界。最终预印本被 Isaac Rajagopal 检查后认为“几乎肯定正确”,而且这种判断不仅是逐行形式上的,也是思想层面的。

Rajagopal 的客座评价更尖锐:第一次改进还可以看作对他工作的常规修改,但从指数级推进到多项式级的想法“相当令人印象深刻”;他说这种想法如果自己花一两周想出来,也会非常自豪,而 ChatGPT 在不到一小时内找到并证明了它。

这个评价让事件的性质发生变化:它不只是“模型能写证明”,而是“模型可能在局部研究项目中贡献一个专家也认可的有效想法”。

三、这是否意味着数学家可以退场?

当然,这并不等于数学家可以退场。Gowers 的实验依然有几个限制。

第一,问题来自已有论文,框架、定义和动机由人类建立。

第二,结果是否正确,仍需要专家检查。

第三,模型擅长的可能是组合数学、加性数论这类“问题驱动”的领域;Gowers 自己也谨慎地说,其他数学方向未必相同,因为有些领域更依赖从一组思想向前发展,并判断哪些观察有趣、哪些只是技术噪声。

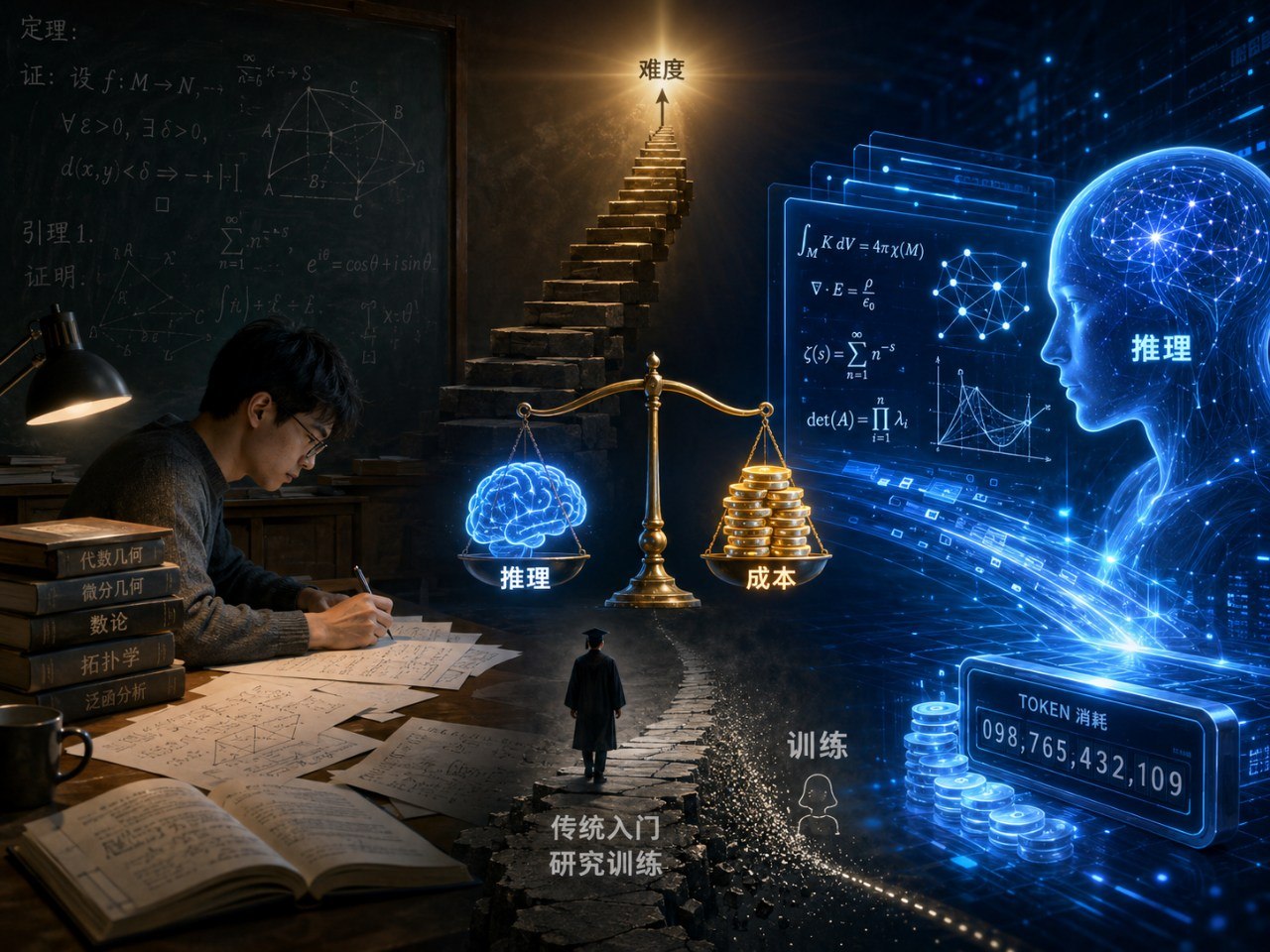

但即便加上这些限制,教育层面的冲击已经很明显。Gowers 说,训练初入门博士生本来就很难,而过去一种常见方式,是给学生一个看起来温和、可能能做出来的开放问题。这样的题目能让新人体验真正研究的鼓励感。现在的问题是:如果 LLM 已经能解决这类“温和问题”,导师就很难再把它们当作训练场。新的训练任务变成:不是证明 AI 不能证明的东西,而是学会与 AI 合作,证明 AI 单独还做不到的东西。

四、数学教育会先被改写吗?

这会改变博士教育的节奏。过去,一个学生可能用几周时间摸索定义、查文献、试错、失败、重组想法,最后获得研究直觉。现在,模型可能几小时内给出一条可行路线。效率提升是真实的,但学习过程可能被压缩得过快。Hacker News 讨论里也有人把它类比为编程教育:初学者当然可以让 LLM 写代码,但若永远跳过手写和调试,就很难真正成为好程序员。数学也是如此,验证一个证明“看起来对”,和自己知道为什么它对,是两种能力。

五、成本会成为新的门槛

成本则是另一条硬约束。OpenAI 官方说明中,GPT-5.5 Pro 面向 ChatGPT Pro、Business 和 Enterprise 用户;API 价格也明显属于高端档位,gpt-5.5-pro 标准价格为每 100 万输入 token 30 美元、每 100 万输出 token 180 美元,长上下文价格更高。对于需要长时间推理、多轮检查、子代理协作和大上下文文献处理的数学研究来说,这不是象征性成本,而会直接决定谁能用、怎么用、能用多久。

HN 社区的第一批反馈也集中在这里:有用户认为 5.5 Pro 的推理和自我修正明显更强,但代价是 token 消耗“疯狂”,一旦使用多代理流程来提高大问题的准确率,成本会进一步上升;同时大规模问题还会受上下文限制拖慢,因为模型需要不断重建局部上下文。

所以,这次事件最重要的判断不是“AI 已经会做数学”这么简单,而是数学研究正在进入一个新经济结构:推理能力变得更便宜,验证、选题、品味和组织变得更贵。过去稀缺的是能想到证明的人;未来稀缺的可能是能提出好问题、识别证明价值、建立可信仓库、决定哪些 AI 结果值得进入数学共同体的人。Gowers 也提出了类似问题:如果一个结果由 AI 生成、确实可发表,但没有传统意义上的作者信用,它应该放在哪里?也许需要一个由人类认证、或由形式化证明系统验证的新型数学结果库。

六、从展示型能力到工作流能力

我的判断是,Gowers 这篇博客标志着数学 AI 从“展示型能力”走向“工作流能力”。过去我们问:模型能否解出一道难题?现在要问:模型能否在文献、定义、构造、证明、修正、写作、同行检查之间形成可重复流程?一旦答案越来越接近“能”,数学家的角色就不会消失,但会更像研究导演、证明审计员、问题策展人和形式化验证协调者。

这并不悲观。人类思想的价值,不只在于“别人做不到”,也在于它能定义什么是值得做的。若 AI 能把温和开放问题快速清空,数学教育确实会失去一批传统练习题;但它也可能迫使导师更早训练学生的判断力、审美、抽象能力和协作能力。真正危险的不是 AI 会证明定理,而是人类放弃理解定理。Gowers 的测试提醒我们:未来的数学训练,不应只是禁止学生使用模型,而应教他们在模型足够强、足够贵、也仍可能犯错的世界里,如何保持自己的数学感。