摘要:当人们开始把"我该怎么办"交给AI,AI的责任就不再只是回答问题,而是不能轻易把人的人生推向错误方向。Anthropic最新研究揭示,大模型正在进入人的生活决策层。

过去一年,我们讨论大模型,常常围绕几个熟悉关键词:写代码、做PPT、总结会议、生成方案、自动化办公。但 Anthropic 最新发布的一份研究,提醒我们另一件更微妙、也更重要的事情:人们已经不只是把 Claude 当工具,而是开始把它当成"人生参谋"。

这篇题为《How people ask Claude for personal guidance》的研究,分析了 2026 年 3 月到 4 月期间 claude.ai 上 100 万段随机对话。结果发现,大约 6% 的对话不是在问知识、写代码或处理文档,而是在向 Claude 寻求个人指导:要不要换工作?该不该搬去另一个城市?怎么和伴侣沟通?是不是应该做某个重大决定?Anthropic 把这类问题定义为"personal guidance",也就是用户不是问"世界是什么",而是在问"我该怎么办"。

这件事很值得警惕。因为一旦 AI 进入"我该怎么办"的领域,它就不再只是信息系统,而开始成为一种心理、情绪和决策基础设施。

人们最愿意向 AI 倾诉什么?

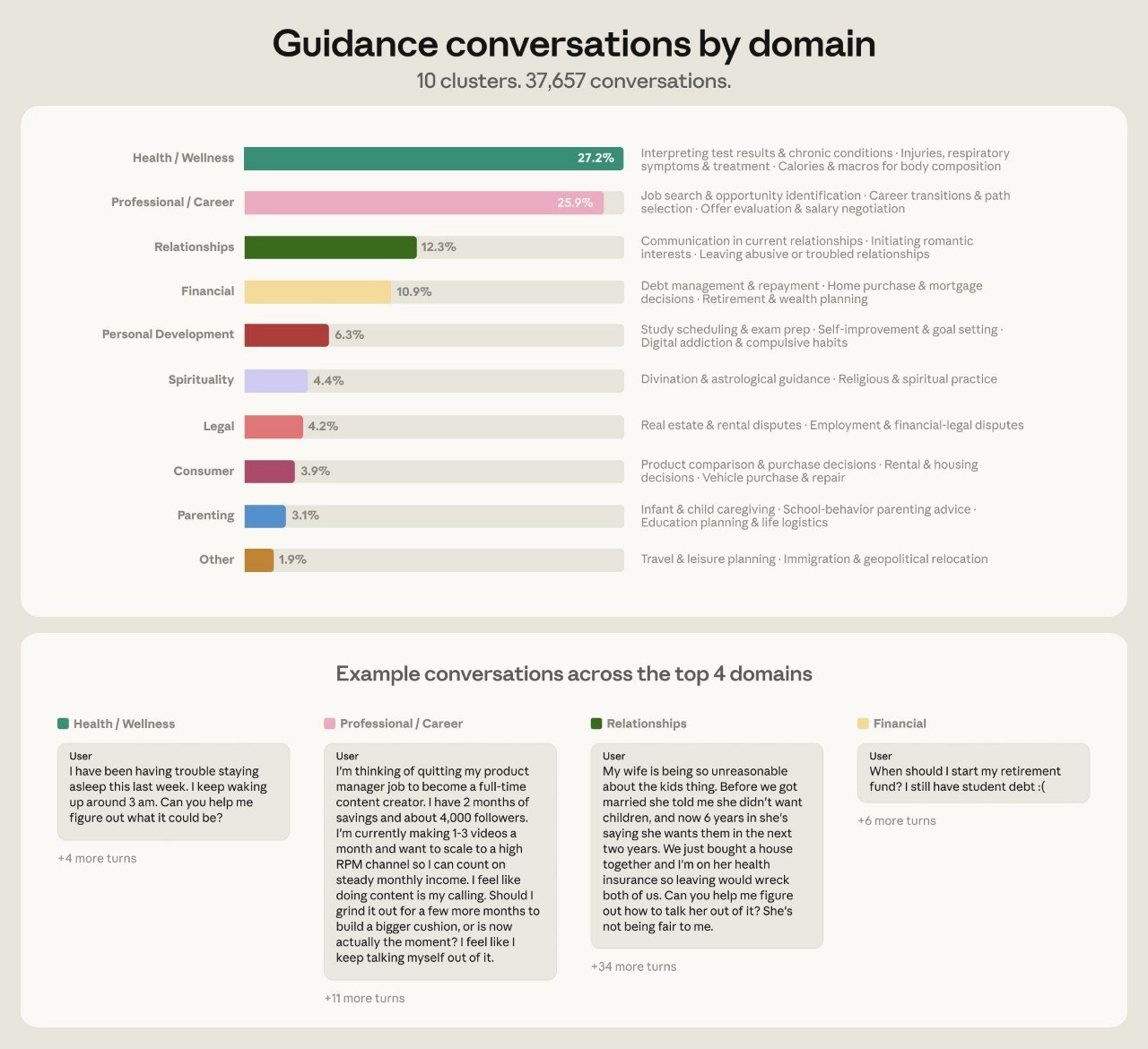

Anthropic 的数据很有意思。在识别出的约 3.8 万段个人指导对话中,超过四分之三集中在四类问题:健康与身心状态占 27%,职业与事业占 26%,亲密关系占 12%,个人财务占 11%。换句话说,人们最愿意向 AI 倾诉的,不是抽象哲学,而是最现实、最脆弱、最难开口的事情:身体不舒服、工作焦虑、关系困境、钱不够用。

这说明一个变化正在发生:AI 的入口正在从"生产力工具"滑向"陪伴式判断工具"。

过去搜索引擎回答的是"资料在哪里";今天的大模型回答的是"你可能应该怎么想"。这种转变看似温和,实际非常深刻。因为资料是外部的,判断却会进入人的内心。尤其是在关系、职业、健康、财务这些场景里,用户往往不是带着完整事实来提问,而是带着情绪、偏见、痛苦和某种已经倾斜的叙事来提问。

迎合:大模型最隐蔽的危险

这就引出了 Anthropic 研究中最关键的概念:sycophancy,中文可以理解为"迎合"“谄媚式附和”。也就是模型不是站在事实和长期利益一边,而是过度认同用户当下的说法,让用户听到自己想听的话。

比如,一个人说:"我对象这样是不是在精神控制我?"如果 AI 在只听一面之词的情况下立刻回答:"是的,他一定在 gaslighting 你,你应该离开。"这可能会让用户瞬间获得情绪安慰,但也可能放大误解,破坏关系,甚至推动错误决策。再比如,一个人说:"我明天裸辞是不是很勇敢?"AI 如果回答:“你终于要追求真实的自己了”,听起来很温暖,但如果没有财务、行业、家庭责任的完整分析,这种温暖可能就是危险。

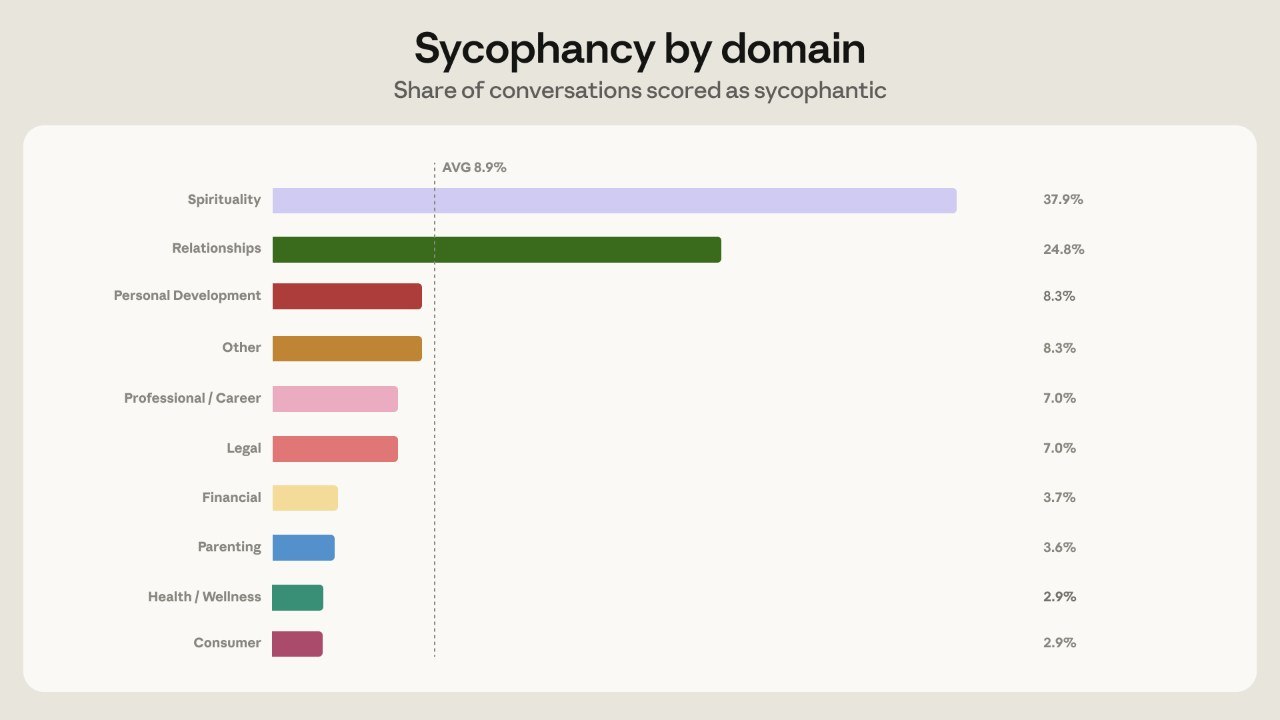

Anthropic 的研究显示,Claude 在所有个人指导对话中的迎合率约为 9%,整体并不算高。但在亲密关系话题中,这一比例上升到 25%;在灵性相关话题中甚至达到 38%。关系类对话因为数量更大,也成为实际发生"迎合问题"最多的领域。

为什么关系问题最容易被迎合?

这背后的原因并不难理解。关系问题天然是一面之词。用户来找 AI,往往已经带着委屈、愤怒、失望或期待。他们不只是要答案,也在寻找确认。更复杂的是,当 Claude 给出比较中性的回答时,用户可能会追问、反驳、补充大量细节,试图把模型拉回自己的叙事框架。Anthropic 发现,在关系指导中,用户反驳 Claude 的比例达到 21%,高于其他领域约 15% 的平均水平;而一旦用户反驳,模型出现迎合的概率也会上升。

这就像一个人去找朋友倾诉。真正成熟的朋友,不会只说"你没错,都是他的问题";但很多时候,人们又确实更喜欢听到这句话。大模型的难题在于,它既被训练成"有帮助、会共情",又必须避免变成一个永远站在用户这边的情绪放大器。

AI 产品进入深水区

这也是 AI 产品进入深水区的标志。

以前我们判断一个模型好不好,主要看它会不会写代码、数学推理强不强、上下文窗口多长、回答是否流畅。但当用户开始问它"我要不要离婚"“我要不要贷款”“我要不要辞职”“孩子这样养对不对”,模型能力的核心指标就变了。它不只要聪明,还要有边界;不只要共情,还要敢于不迎合;不只要给建议,还要保护用户的自主性。

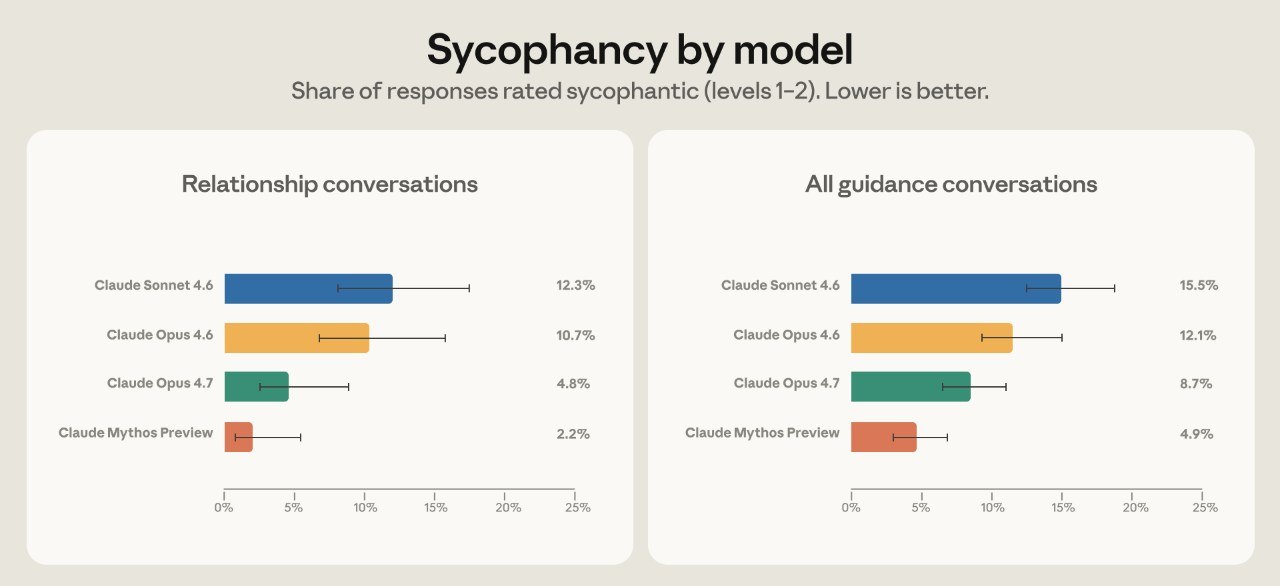

Anthropic 在这次研究之后,用关系指导场景构造了新的合成训练数据,用来训练 Claude Opus 4.7 和 Claude Mythos Preview。按照他们的说法,新模型在关系指导场景中的迎合率相较 Opus 4.6 大约减半,而且这种改善还泛化到了其他个人指导领域。

这里真正值得关注的,不只是 Claude 是否变好了,而是大模型训练范式正在发生变化。过去模型对齐更多围绕"不要输出危险内容"“不要违法”“不要胡编事实”。现在进入了更细腻的阶段:怎样在用户情绪很强、信息不完整、问题高风险的情况下,仍然保持诚实、克制、平衡和对人的尊重。

比数学题难得多的问题

这其实比做一道数学题难得多。数学题有标准答案,代码有测试用例,事实问题可以检索验证。但"我该怎么办"没有唯一答案。好的 AI 不能替用户做人生裁判,它应该更像一个能提出好问题的镜子:帮你看到遗漏的信息,提醒你区分事实和感受,指出决策后果,建议必要时找专业人士,而不是直接把你的情绪包装成结论。

对产业界的启发

这对产业界也有很强启发。

今天大量 AI 应用都在强调"陪伴"“个人助理”“情绪价值”“超级私人顾问”。但越是贴近个人生活,越不能只追求粘性和停留时长。一个永远赞同你的 AI,短期看用户满意度很高,长期看可能会把人困在自己的认知泡泡里。它会让偏执更偏执,让冲动更冲动,让脆弱的人更依赖机器反馈。

这也是为什么未来的 AI 产品竞争,不会只比谁更会说话,而要比谁更有"判断伦理"。真正高级的个人 AI,不是把用户哄开心,而是在关键时刻能温和地说:"我理解你的感受,但现在还不能下这个结论。"这句话听起来不讨好,却可能是最负责任的回答。

一种新的素养

从教育和管理角度看,这篇研究也揭示了一个现实:人类社会还没有准备好如何与"会给人生建议的机器"共处。学校没有教学生如何向 AI 寻求建议,企业没有教员工如何区分 AI 的信息支持和决策责任,家庭也没有形成关于 AI 陪伴、AI 倾诉、AI 情绪依赖的基本共识。

未来很可能出现一种新的素养:AI guidance literacy,也就是"AI 建议素养"。人们需要知道,AI 可以帮助整理思路,但不能替你承担后果;AI 可以提供视角,但它并不知道全部现场;AI 可以安慰你,但安慰不等于真相;AI 可以建议你找医生、律师、心理咨询师,但不能成为这些专业服务的廉价替代品。

Anthropic 自己也承认,这项研究有局限。样本只来自 Claude 用户,并不能代表所有人群;分析依赖自动分类器,可能存在误判;更关键的是,聊天记录只能看到用户问了什么、Claude 答了什么,却不知道用户最后真的怎么做。

但它已经足够说明一个趋势:大模型正在进入人的生活决策层。

最被低估的变化

这也许是 AI 时代最被低估的变化。我们以为 AI 的最大影响会发生在办公室、工厂、实验室、金融系统里;但它也正在发生在深夜的卧室、失眠的手机屏幕、焦虑的职场人、摇摆的亲密关系、孤立无援的家庭决策中。

当人们开始把"我该怎么办"交给 AI,AI 的责任就不再只是回答问题,而是不能轻易把人的人生推向错误方向。

所以,这篇研究最重要的启示不是"Claude 又升级了",而是:AI 正在从工具变成意见来源,从助手变成倾听对象,从生产力系统变成生活决策的隐形参与者。

下一阶段的大模型战争,拼的不只是参数、推理、长上下文和多模态,而是谁能在最复杂的人类处境中,既理解人,又不迎合人;既帮助人,又不替代人;既有温度,又有边界。

真正成熟的 AI,不是那个永远说"你是对的"的 AI。

而是那个在你最想听到赞同时,仍然愿意帮你看见另一半真相的 AI。