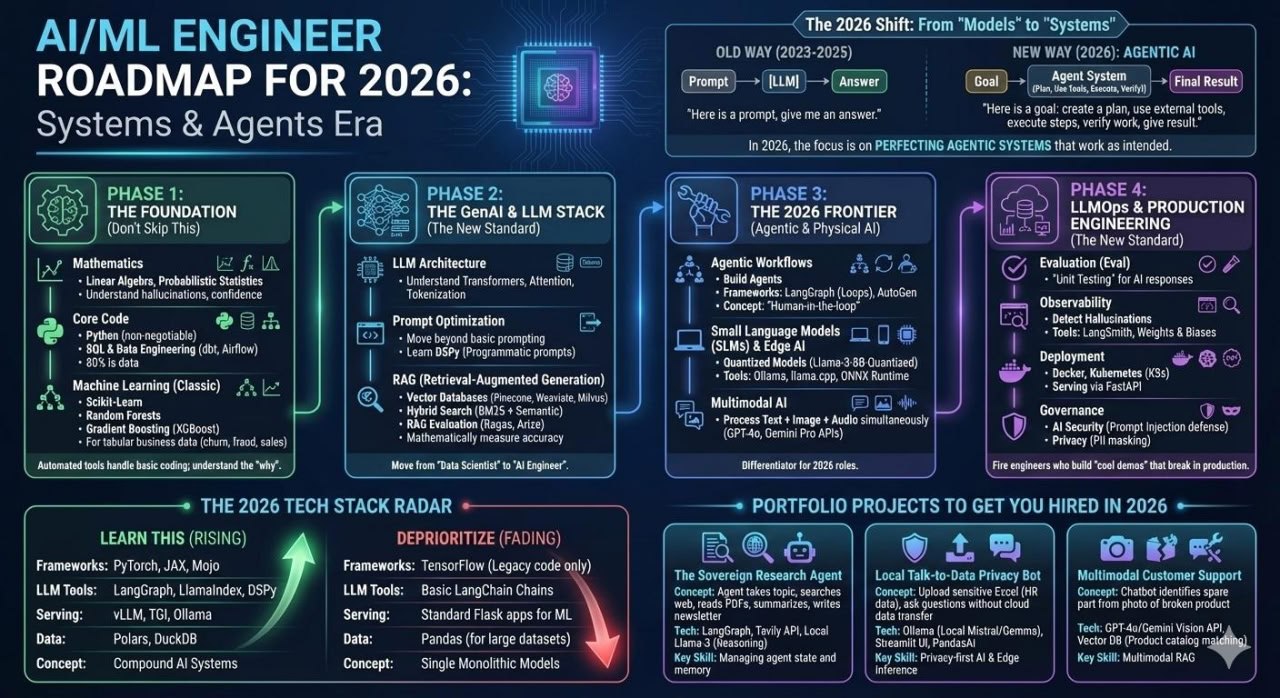

这两年,很多人都在说自己做 AI:有人接了个大模型 API,套了个聊天框;有人把提示词打磨得越来越漂亮;也有人把"智能体"三个字贴到任何一个工作流上,仿佛项目瞬间就高级了。但 Rohit 在 《The 2026 AI Engineer Roadmap》 里抛出的判断很直接,也很刺耳:大多数开发者还在造玩具,而这个世界真正需要的是系统。 他反复强调,市场已经被各种薄薄一层的 GPT/Claude 套壳塞满了,这些东西不是壁垒,更像是下一次平台更新就会被顺手吞掉的功能。真正拉开差距的,不是谁更会写提示词,而是谁能把模型、工具、记忆、权限、恢复机制和真实业务拼成一个能活下来的系统。

Rohit 这份 roadmap 最精彩的地方,不是空谈趋势,而是直接给了 5 个递进式案例。它像一条非常现实的升级路径:先学会在受限环境里做 AI,再学会让 AI 自己迭代;再往上,要处理多模态、长期记忆、价值对齐,最后进入企业级自治工作流。你会发现,这根本不是"学哪个框架"的问题,而是在训练一种新的工程直觉:从调用模型,升级为设计系统。 这也是为什么这 5 个案例值得认真讲清楚,因为它们几乎对应了 2026 年 AI 工程里最有价值的五种能力。

案例一:离线优先的小模型手机应用

很多人一看到这个题目,第一反应是"太基础了",仿佛只要做个本地聊天界面就行。但 Rohit 真正要你证明的,恰恰不是"会做界面",而是"会在约束里做工程"。因为一旦 AI 真的跑到手机上,问题立刻就变了:模型不能一直占着内存,要按需懒加载;旧设备可能只能跑 4-bit 量化,新设备才适合 8-bit;上下文窗口不能无限堆,只能靠滑动窗口和语义切块保留最相关内容;电量低的时候,还要控制推理频率,把不关键的任务延后;本地数据则必须加密保存,是否同步到云端,也要由用户自己决定。

这个案例表面是在做端侧 AI,本质上是在训练一个工程师最重要的基本功:你面对的不是理想环境,而是资源、隐私、续航和用户体验同时存在的现实世界。

案例二:自我改进的编码代理

这一步是很多 AI 应用真正的分水岭。聊天机器人等的是提示词,代理等的是目标。Rohit 把这个案例设计成一个完整闭环:先规划,再执行,再测试,再反思,直到代码真的可用为止。这里的关键不是"让模型会写代码",而是让整个系统具备持续修正自己的能力。

于是你就会看到一整套真正有工程含量的结构:每次任务都在隔离沙箱里执行,对 CPU、内存和运行时长设上限;短期记忆保存最近几轮迭代,上下文不至于断;长期记忆保存成功模式;失败记忆则专门记录错误签名、出错原因以及最终修复方案。这样一来,AI 下次再撞到类似问题时,不是从零开始瞎试,而是先把过去的失败教训调出来。

这一层的价值特别大,因为它说明一个真正的 AI 工程师,思考的已经不是"怎么让模型更聪明",而是怎么让系统少犯重复错误,怎么让错误本身变成资产。

案例三:多模态视频编辑代理

这个案例一看就比前两个更"炸",但真正难的不是炫技,而是把人的模糊审美翻译成机器能执行的参数。用户说一句"让我这段更 cinematic 一点",人类编辑能大概明白,但机器如果只会回一段解释,根本没有价值。

Rohit 给出的思路,是让视觉模型分析每一帧的构图、光线和主体,让音频模型分析对白、配乐和环境声,再把"电影感"这种抽象需求翻译成具体操作,比如放慢节奏、降低饱和度、增强背景虚化、调整音乐节点、优化转场和镜头切点。更进一步,系统还要先生成完整的编辑决策列表,判断叙事逻辑是否连贯,再只渲染受影响的局部片段,而不是每改一次就全片重算。甚至连"为什么这里切一刀"都要能解释出来。

这说明多模态 AI 最难的地方,从来不是"看懂视频",而是把主观意图,变成可以落地的工作流。 谁能做到这一点,谁就不是在做玩具,而是在重写专业软件的交互方式。

案例四:Personal Life OS Agent

读到这里,你会发现 Rohit 的视野已经不再是生产力工具,而是在逼近真正的长期智能体。他设想的,不是一个只会提醒日程的助手,而是一个持续摄入日历、财务、健康和沟通数据的个人代理。它要从这些信息里抽取人、地点、项目和关系,逐步搭出一个动态的个人知识图谱;每隔几个小时在后台扫描模式变化,比如会议密度持续上升、睡眠质量持续下降,然后在问题变成崩溃之前,先提醒你"你可能已经在透支自己了"。

更重要的是,这个系统不是只追求效率,而是要接收用户明确表达的价值排序,比如家庭优先于工作、健康优先于收入,然后它所有建议都必须经过这套价值约束。再叠加本地加密、用户自持密钥、敏感操作可完全离线执行、所有建议都附带"为什么这样推荐"的透明解释,这个案例真正想表达的是:未来真正值钱的 AI,不只是更懂任务,而是更懂人;但前提是,它得在懂你的同时,不越界。

案例五:企业级自治工作流代理

到了这一步,AI 已经不再服务于一个人,而是在试图接管一段业务流程。Rohit 描述的系统会持续监听 Slack、Jira、邮件和监控系统里的事件,一旦识别出某种触发模式,就自动套用相应工作流模板;把复杂任务拆成多个有依赖关系的步骤,能并行就并行,时间长的任务则保持可恢复状态;再由总控代理派发给不同的 specialist agents:有人负责对外沟通,有人查日志和数据库,有人做根因分析,有人出报告。

更关键的是,整个系统必须具备企业环境最看重的那些东西:失败重试与熔断、自愈机制、不可变审计日志、基于角色的权限控制、全链路可观测性,以及关键流程里的人类审批节点。说到底,企业不是不想要 AI,企业只是不要一个"会说大话但不能追责"的 AI。真正能进企业核心流程的,只能是那种既能自动化,又能被审计、被限制、被解释、被接管的系统。

五次能力跃迁

把这五个案例连起来看,Rohit 其实讲透了一个很多人还没反应过来的现实:提示词正在快速贬值,系统能力才是新的硬通货。 会调模型的人会越来越多,会做 DEMO 的人也会越来越多,但真正稀缺的,是那些能把模型放进约束里、放进流程里、放进组织里,并且让它在出错、冲突、变更、成本压力和合规要求下依然稳定运行的人。

第一层能力是让 AI"能用",第二层能力是让 AI"会纠错",第三层能力是让 AI"能处理复杂媒介",第四层能力是让 AI"能长期理解人",第五层能力则是让 AI"真正进入组织生产"。这不是五个项目而已,这是五次能力跃迁。

写在最后

Rohit 这份 《The 2026 AI Engineer Roadmap》 真正厉害的地方,不是又给大家灌了一碗焦虑鸡汤,而是它把"2026 年什么样的 AI 工程师最值钱"这件事讲得非常具体:不是 API 搬运工,不是提示词美工,也不是只会套一层工作流包装的"伪智能体开发者"。真正值钱的,是能做边缘部署、能设计代理循环、能处理多模态、能管理长期上下文、能兼顾权限与审计、能把 AI 放进真实业务的人。

说得再直白一点:未来最贵的,不是模型调用次数,而是把模型驯化成系统的能力。 这也是这份 roadmap 留给所有开发者最残酷、也最有用的一句话——别再造玩具了,去造那些能在现实里活下来的东西。