摘要:AI 编码工具正在成为主流工程流程的一部分,但真正值得警惕的,不是它会不会替代程序员,而是它会不会让人越来越习惯于生成自己并不真正理解的代码。

最近,一位开发者在社区里写下反思:自己越来越依赖 AI 编码助手,结果不是变得更强,而是发现批判性思维、调试耐心和编程判断力正在变弱。

这条讨论之所以引发共鸣,是因为它戳中了很多开发者心里那个不太愿意承认的问题:AI 编码工具确实好用,但好用到一定程度以后,它不只是帮你写代码,也可能悄悄改写你学习、思考和解决问题的方式。

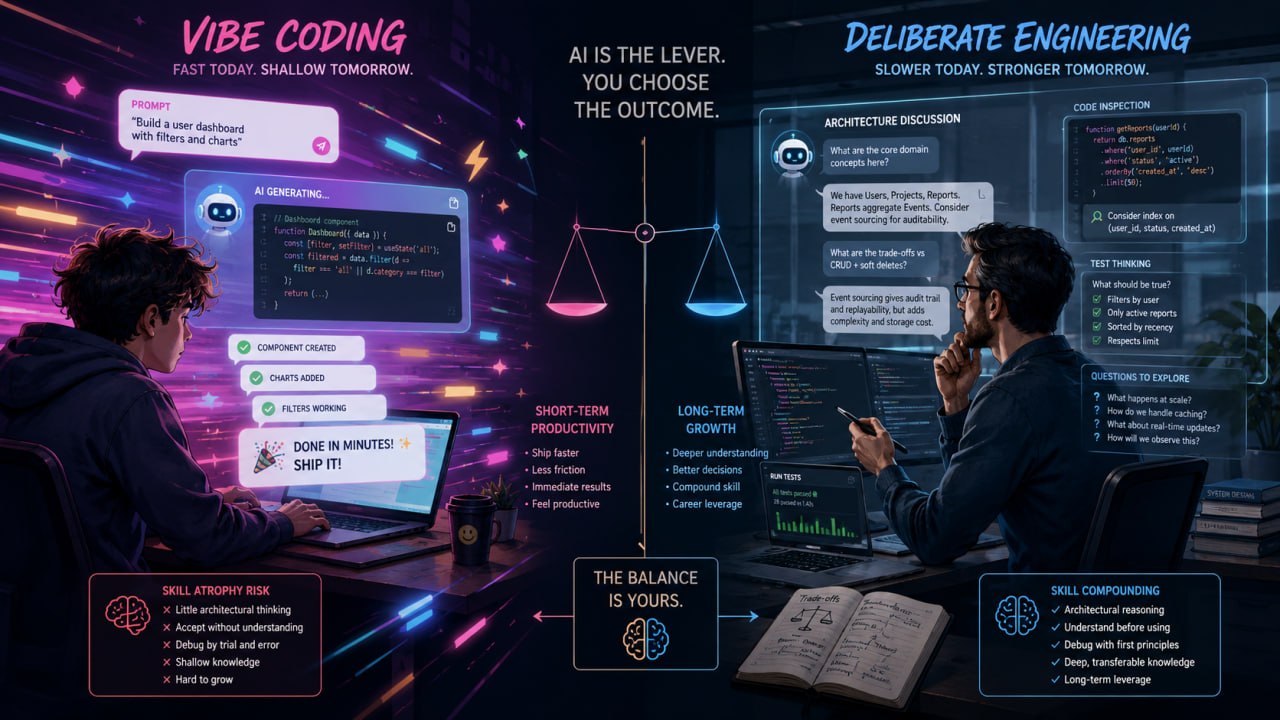

过去写代码,开发者面对的是空白编辑器、报错信息、文档、搜索引擎和自己的脑子。你要拆问题,要查 API,要理解调用栈,要在失败里一点点建立直觉。这个过程很慢,很烦,但它正是能力形成的地方。今天,AI 编码助手把这个过程压缩成了一句话:你描述需求,它生成代码;你贴出报错,它给出修复;你想加功能,它直接改文件。开发者的体验从“亲手建造”变成了“审核和指挥”。

这当然是效率革命。Google Cloud 的 2025 年 DORA 报告显示,AI 在软件开发中的采用已经接近普遍化,受访技术人员中 90% 在工作中使用 AI,超过 80% 表示 AI 提升了生产力,59% 认为 AI 对代码质量产生了正向影响。也就是说,AI 编码不是少数人的玩具,而是正在进入主流工程流程的基础工具。(blog.google)

但同一份现实里也藏着矛盾。Stack Overflow 2025 开发者调查显示,对 AI 工具输出准确性表示不信任的开发者比例为 46%,高于表示信任的 33%;真正“高度信任”AI 输出的人只有约 3%。越有经验的开发者越谨慎,因为他们知道代码不是能跑就行,真正的问题往往藏在边界条件、系统约束、安全风险和未来维护里。(Stack Overflow Insights)

这就是 AI 编码的第一层悖论:大家都在用,但大家并不完全信。

更深一层的悖论:AI 可能提升产出,却削弱成长

Anthropic 在 2026 年发布过一项关于 AI 辅助对编码技能形成影响的随机对照研究。研究让软件工程师在有无 AI 辅助的情况下学习并使用一个新的 Python 库,随后进行测验。结果显示,使用 AI 辅助的一组在掌握程度上显著更低,测验得分比手写代码组低 17%,相当于接近两个字母等级的差距;而 AI 带来的速度提升并没有达到统计显著。更重要的是,研究也指出,并不是所有 AI 使用都会造成能力下降,那些会追问原理、要求解释、把 AI 当成理解工具的人,保留知识的效果更好。(Anthropic)

这个结论非常关键。问题不是“用不用 AI”,而是“你用 AI 的时候,大脑是否还在工作”。

所谓 vibe coding,最危险的地方不在于它让人写代码更快,而在于它让人误以为“生成了代码”就等于“理解了系统”。一个提示词下去,项目跑起来了,页面出来了,接口通了,开发者获得了即时正反馈。可一旦遇到奇怪 bug、性能瓶颈、安全漏洞、并发问题、数据一致性问题,表面的流畅就会变成负债。因为你没有经历过设计取舍,没有在错误里建立模型,也没有真正理解代码为什么这样写。

这对初级开发者尤其危险。

老程序员使用 AI,往往是在已有知识结构上加速。他知道模型生成的代码哪里可能偷懒,知道哪些地方必须写测试,知道框架的惯例和反惯例,知道一次“看起来合理”的重构可能埋下什么坑。AI 对他来说像一个速度很快但需要监督的初级同事。

但初级开发者不一样。他还没有足够的判断力,却先获得了看似高级的输出。他不会写异步代码,但 AI 能写;他不懂数据库事务,但 AI 能补;他没理解 React 状态管理,但 AI 能改到页面能跑。于是最可怕的事情发生了:他跳过了痛苦,也跳过了训练。

编程能力不是靠看正确答案长出来的,而是靠不断做错误判断、调试、修正、再理解长出来的。你必须亲手踩过坑,才知道抽象为什么重要;必须被线上问题打过,才知道日志和可观测性为什么重要;必须维护过烂代码,才知道“先跑起来”只是软件生命周期的第一分钟。

如果 AI 把所有困难都提前抹平,初级开发者会越来越像一个“会提需求的人”,但不一定成为一个真正能负责系统的人。

AI 像放大器,放大的其实是人的习惯

这也是为什么社区讨论里会出现两种截然不同的声音。一类人说,AI 让我变懒了。我不再深入思考,不再读文档,不再先自己尝试,而是遇到问题就问模型。另一类人说,AI 让我学得更快,因为我会不断追问:为什么这样写?还有没有别的方案?这个抽象的代价是什么?如果换成生产环境会出什么问题?

两种体验都是真的。AI 像放大器,放大的不是工具本身,而是人的使用习惯。你把它当拐杖,它就削弱肌肉;你把它当教练,它就增加训练强度。

所以,真正需要区分的不是“AI 编码”和“手写代码”,而是“AI 替代思考”和“AI 促进思考”。

Addy Osmani 曾经把 vibe coding 和 AI-assisted engineering 区分开来:前者强调跟着感觉快速提示、快速生成、快速试错,适合原型、实验和一次性项目;后者则是把 AI 放进成熟工程流程里,有设计文档、有代码审查、有测试、有可维护性要求,人仍然对架构、理解和最终质量负责。这个区分很重要,因为把两者混为一谈,会让新人误以为只要会提示词,就能绕过工程训练。(Medium)

在专业软件工程里,代码从来不是唯一产物。真正的产物是可维护的系统,是团队可以理解和接手的结构,是上线后可观测、可回滚、可演进的能力。AI 可以生成函数,但它不天然理解公司的业务债务;AI 可以补测试,但它不知道哪个边界条件最值钱;AI 可以解释报错,但它不承担凌晨三点服务雪崩的责任。

所以,程序员的价值正在从“会不会写代码”转向“能不能判断代码”。

这不是轻松的升级,而是更苛刻的要求。过去,一个程序员可以通过大量手写代码建立基本功,然后逐渐学会架构、协作和系统判断。现在,AI 把低层任务自动化以后,行业反而更需要开发者更早拥有高级判断力。可是高级判断力又恰恰来自低层训练。这就形成了新的断层:工具提高了入门表象,却可能削弱真正入门的路径。

怎么办?

第一,学习阶段不能完全 vibe coding。学新语言、新框架、新算法、新系统时,至少要保留一部分手写训练。不是因为手写代码更高贵,而是因为大脑需要“困难”。困难不是低效,困难是训练信号。你可以让 AI 解释,可以让 AI 提示方向,但不要让它一开始就给完整答案。

第二,使用 AI 时要强制反问。每次接受代码前,至少问三个问题:为什么这样写?还有哪些替代方案?它在哪些情况下会失败?如果这三个问题答不上来,你只是复制了代码,不是完成了工程。

第三,把 AI 生成代码视为“待审稿件”,不是“成品”。模型输出越流畅,越需要测试、审查和边界验证。尤其是权限、安全、并发、数据迁移、支付、隐私、基础设施配置这些部分,不能因为 AI 写得像专家就放松警惕。

第四,团队要重新设计初级开发者培养方式。过去让新人修小 bug、写 CRUD、补测试,是为了让他们建立肌肉记忆。现在这些任务很容易被 AI 承包,但新人仍然需要训练。公司不能只看提交速度,还要看新人是否能解释改动、定位问题、写出设计取舍、理解失败原因。否则团队会得到一批“产出很多、理解很浅”的人。

第五,程序员个人要保留“无 AI 时间”。不是为了抵抗技术趋势,而是为了维护自己的底层能力。就像计算器没有消灭数学训练,GPS 没有消灭方向感的重要性,AI 编码助手也不应该消灭程序员对代码和系统的亲手理解。

AI 不会替你成为更好的工程师

AI 编码的未来不会倒退。越来越多代码会由模型生成,越来越多工程流程会由 agent 参与,越来越多软件会先通过自然语言被描述出来。这是不可逆的。但越是这样,人的判断越重要。因为当代码生成变便宜,真正稀缺的就不再是代码,而是问题定义、系统理解、风险意识和技术品味。

最终,AI 不会让所有程序员变弱,也不会自动让所有程序员变强。它会把人分成两类。

一类人会把 AI 当成答案机器,越来越快地生成自己无法解释的东西。他们看起来很高产,但能力空心化,遇到复杂问题就只能继续求助模型。

另一类人会把 AI 当成陪练,把每一次生成都变成追问,把每一次错误都变成理解,把每一次自动化都变成更高层次的思考。他们写的代码可能越来越少,但对系统的掌控会越来越强。

真正的问题不是 AI 会不会削弱编程能力,而是你有没有把自己的思考权交出去。

工具越强,人越不能只追求省力。因为软件工程最值钱的部分,从来不是敲键盘的速度,而是在混乱中看见结构、在不确定中做出判断、在看似正确的代码背后发现真正的问题。AI 可以帮你写得更快,但不能替你成为一个更好的工程师。